如何在 Mac 上本地安裝最新的大型語言模型 (LLM)

近年來,大型語言模型(LLM)因其能夠產生類人文本並輔助完成各種任務而日益普及。並非所有模型都是開源的,但幾乎所有主流科技公司都提供可供用戶下載運行的版本。

在 Mac 本地運行這些模型,無論從隱私或成本角度來看,都是有益的。本文將探討如何使用 Mac 安裝和執行 LLM。 奧拉馬它對於開發者和新手使用者來說都是一個強大的工具,我們將討論一些圖形使用者介面工具,這些工具可以簡化那些不想使用 macOS 終端機的使用者的操作過程。

透過這種方式,您可以存取來自 [Google]、[Microsoft]、[Meta] 和其他 AI 公司(如 [Mistral] 和 [DeepSeek])的最新 AI 驅動的文字範本。

理解LLM:參數的含義是什麼?

在深入探討安裝過程之前,讓我們先明確一下諸如“7B或者 ”14B在提及線性線性模型(LLM)時,這些數字表示模型的大小(以…為單位)。 老師們 (以數十億計),它們本質上是“把手和開關”,在訓練過程中進行精確調整。

更多的參數可以讓模型捕捉語言中更複雜的模式和關係,從而有可能提升效能。然而,需要注意的是,參數越多並不總是保證更好的結果;訓練資料的品質和模型可用的計算資源也起著至關重要的作用。

系統要求

您需要確保您的[Mac]至少符合以下配置要求:

- macOS 10.15 或更高版本(建議使用 macOS 13 或更高版本)

- 至少需要 8GB 記憶體(建議 16GB 或更高)

- 10GB 可用儲存空間(最小型號的最低要求;參數較多的更高級型號大約需要 700GB)

- [Intel] 多核心處理器或 [Apple Silicon] 處理器(首選 M2 或更高版本)

安裝奧拉瑪

奧拉馬 這是一個開源工具,可讓您直接在本機電腦上執行 LLM。以下是入門指南:

- 下載 Ollama造訪網站: 奧拉馬 下載 macOS 版本。您也可以使用 [Homebrew] 透過執行以下命令進行安裝。

brew install ollama在您的終端中。

- 安裝奧拉瑪如果您下載了安裝程序,請按兩下執行並依照安裝精靈進行操作。如果您使用的是 Homebrew,請跳至步驟 4。

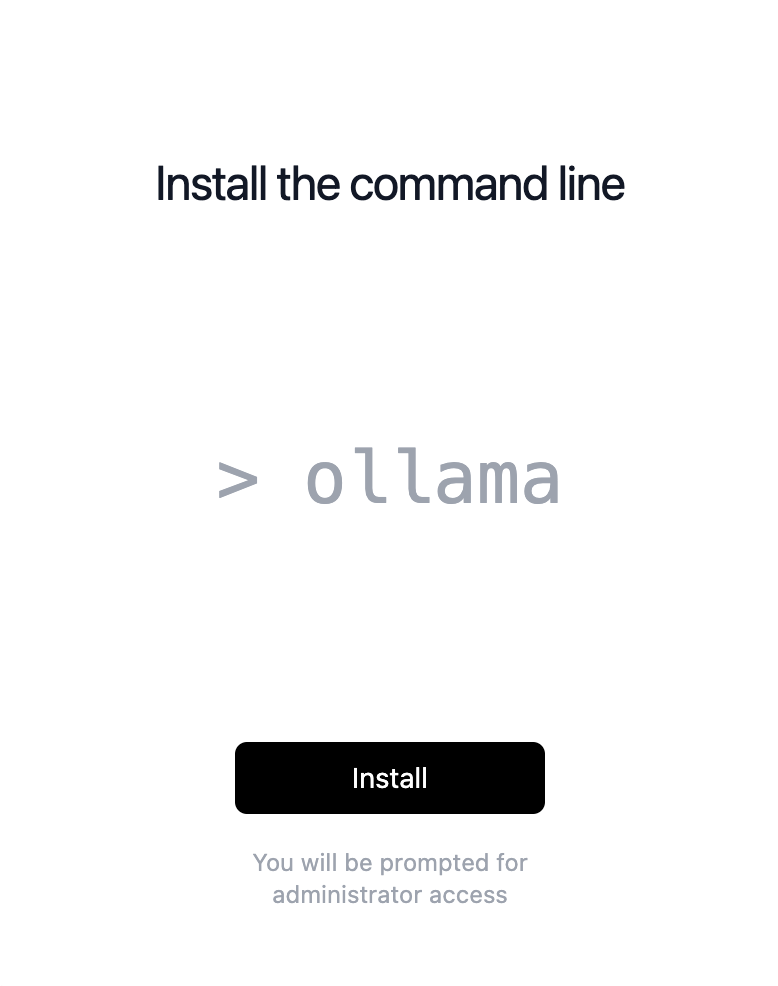

- 安裝程式的下一步操作只需單擊該按鈕即可。 تثبيت系統會要求您輸入管理員密碼。

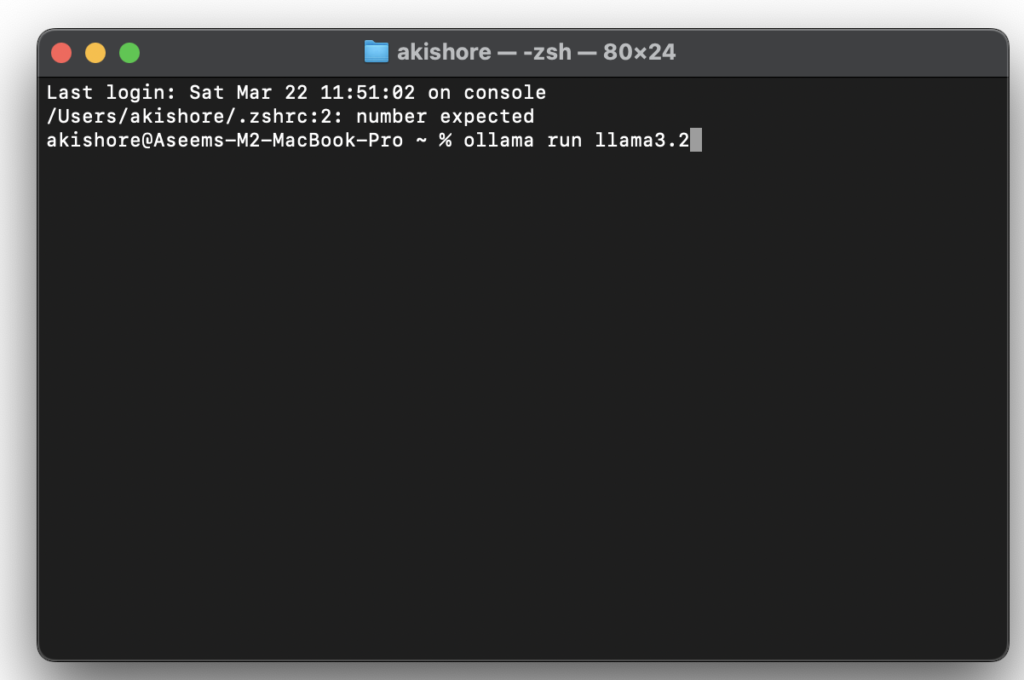

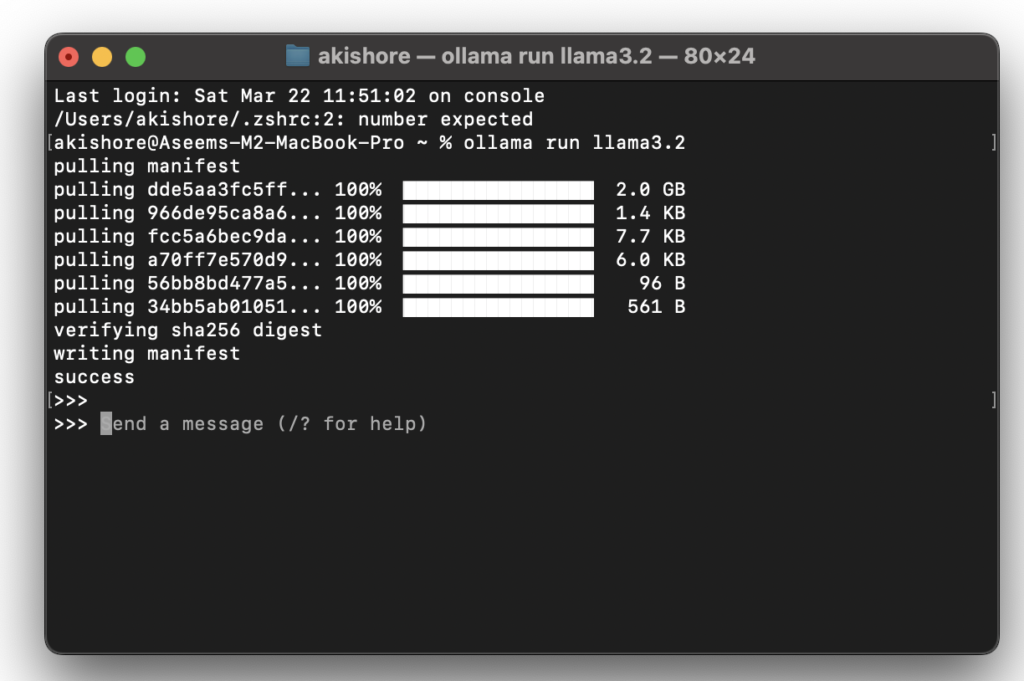

- 奔跑奧拉馬打開終端機窗口,並使用以下命令將 Ollama 作為服務啟動。

brew services start ollama這將使 Ollama 能夠在地址上提供服務。http://localhost:11434/. - 下載並運行模型使用命令

ollama pull <model-name>若要下載模板,請使用以下命令。ollama run <model-name>運行它。例如,運行一個模型 DeepSeek-R1, 使用命令ollama pull deepseek-r1接下來是訂單ollama run deepseek-r1. - 要下載更大尺寸的模板,只需添加兩個豎點,後跟尺寸即可。例如,要下載一個模板 14B DeepSeek您將使用命令 ollama 運行 deepseek-r1:14b在 Ollama 網站上,您可以點擊任何表單,每個版本的所有不同命令都會顯示出來。

您可以找到完整的列表 奧拉瑪模型 這裡。您也可以使用上面描述的第二個命令,如果該命令尚未安裝,它會先拉取表單,然後再執行它。

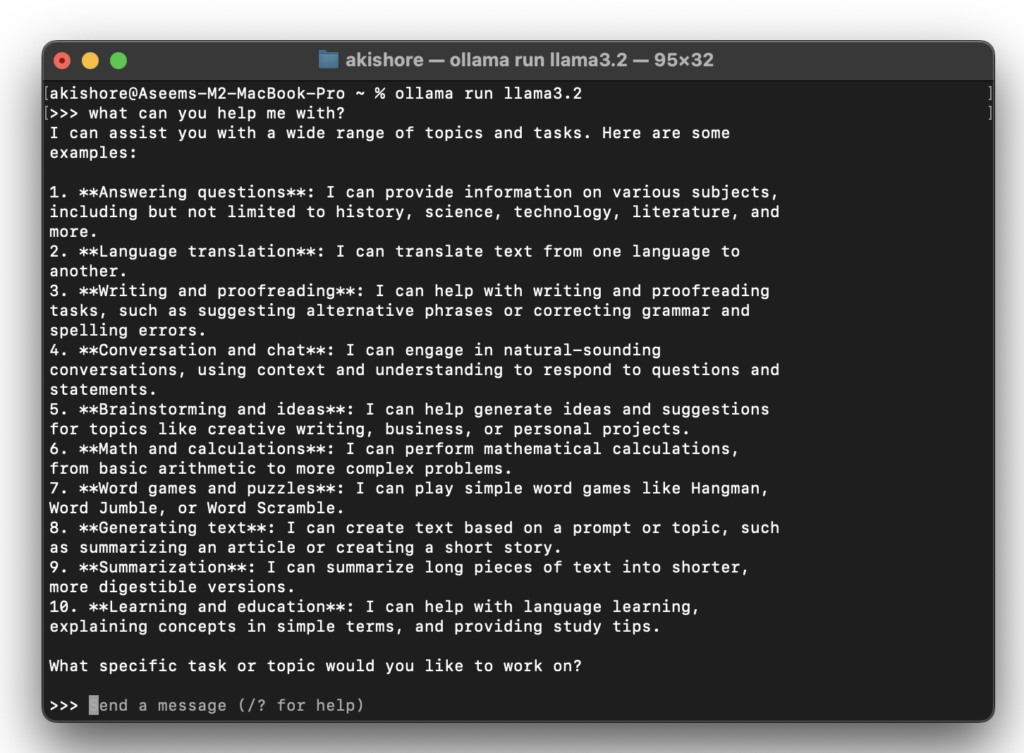

現在您看到了三個直角箭頭(>>>),就可以開始在表單中輸入指令了。

就是這樣!現在您可以與您的AI語言學習導師進行在地互動,無需擔心費用、過度使用或他人讀取您的文字。如果您想與AI語言學習導師討論一些敏感或個人主題,但又不希望大型科技公司窺探您的想法,這無疑是最佳選擇。

使用 Ollama 的圖形使用者介面工具

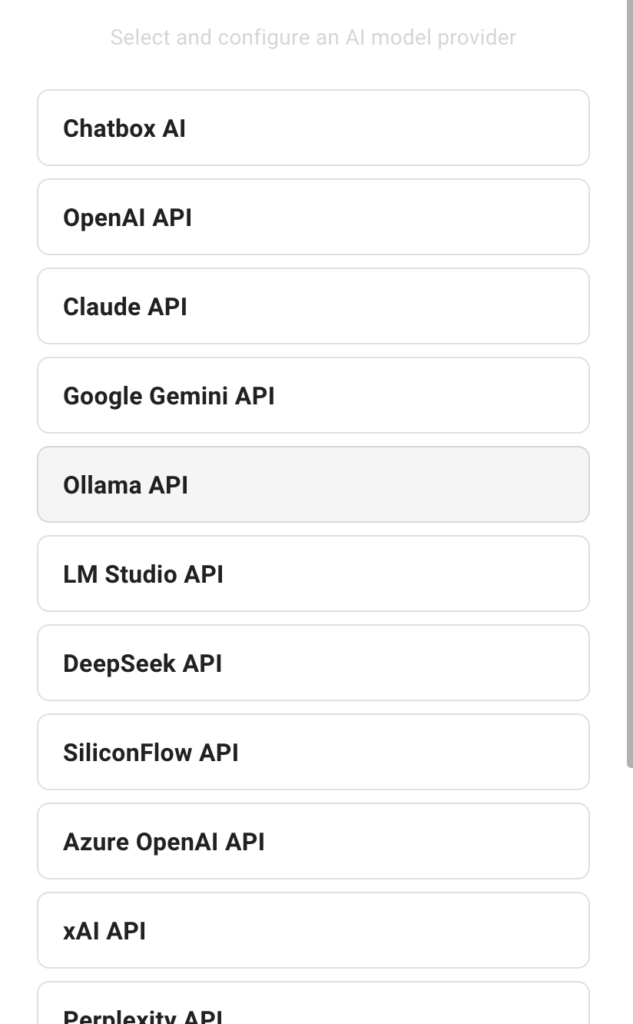

雖然 Ollama 對開發者來說功能強大且高效,但有些使用者可能更喜歡使用圖形使用者介面 (GUI) 與 LLM 進行互動。以下是一些可以為 Ollama 提供 GUI 前端的工具:

-

-

- Ollama GUI這是一個面向 macOS 用戶的免費開源應用程序,使用 SwiftUI 建置。它擁有美觀的介面,對於那些希望在本地存取 LLM 表單而無需使用終端的用戶來說,是一個絕佳的選擇。

- Ollama UI這是一個基於 HTML 的簡潔網頁使用者介面,可讓您直接在瀏覽器中定義表單並與之互動。它還包含一個 Chrome 擴充程序,方便您輕鬆存取。

- 聊天框人工智慧這是最適合初學者的選擇,我會在下面解釋它的使用方法。請注意,您無需購買 Chatbox AI 服務(這是他們提供的訂閱服務),因此您可以存取所有 LLM 範本而無需自行安裝 Ollama。

-

若要使用最佳聊天機器人AI介面,請前往 下載頁面 取得適用於Mac的版本。

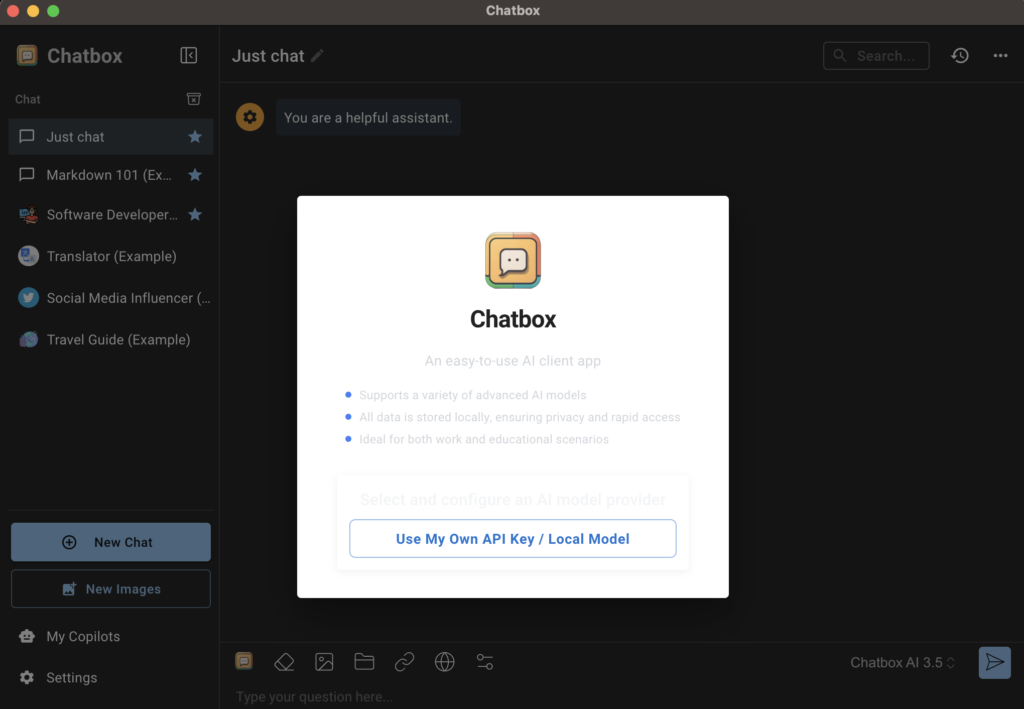

接下來,打開安裝程式並運行程式。在第一個畫面上,會彈出一個視窗詢問您如何使用聊天機器人AI。

您需要點擊按鈕 使用我自己的 API 金鑰/本機模型.

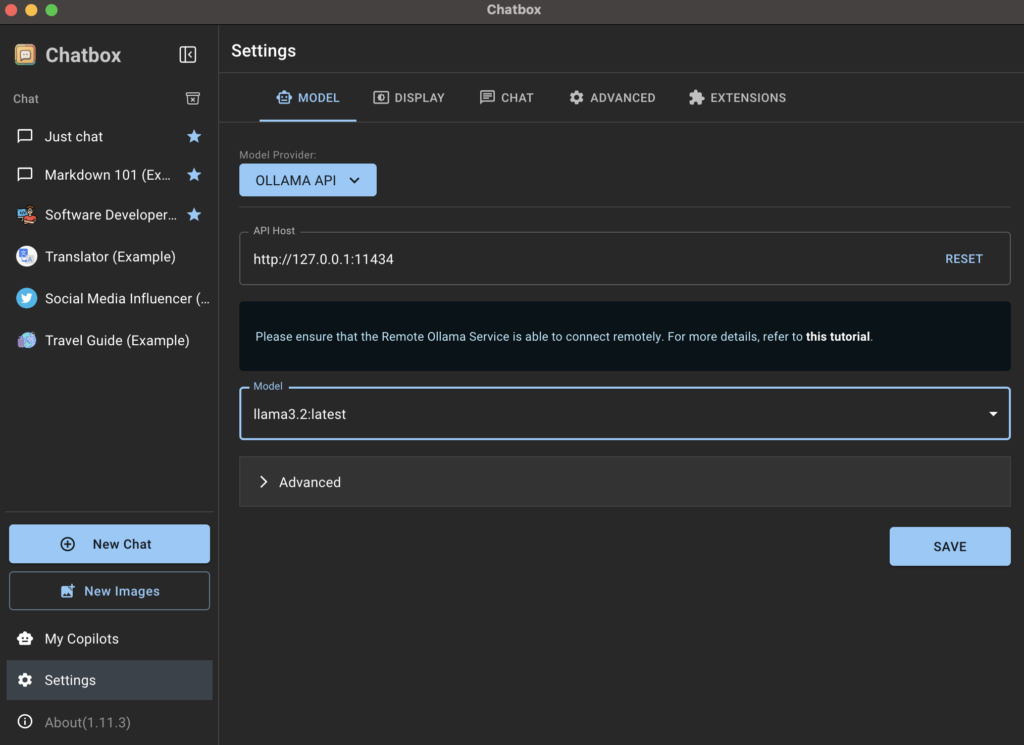

接下來,點按 Ollama API 作為人工智慧模型提供者。

Chatbox AI 應該會自動偵測到 Ollama 正在運行,並將 API 主機設定為其預設值,即 循環返回 IP 位址 和端口號 11434這裡不需要做任何更改。在這個表單中,你應該可以看到之前使用終端機安裝的表單。就我而言,它是這個表單。 駱駝 3.2.

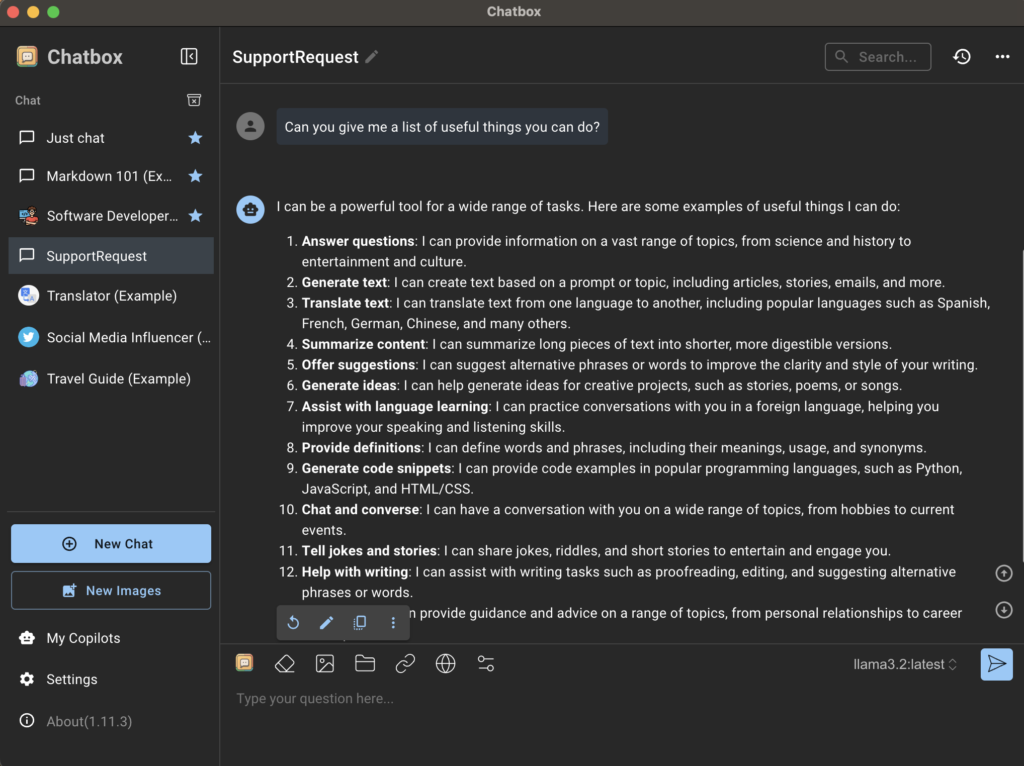

返回應用程式主頁,點擊 只是聊聊 أ或者 新聊天 請務必在右下角選擇正確的模板。您可以隨時更改模板,但我建議您為每個使用的模板建立新的聊天記錄,這樣可以方便地查看差異。

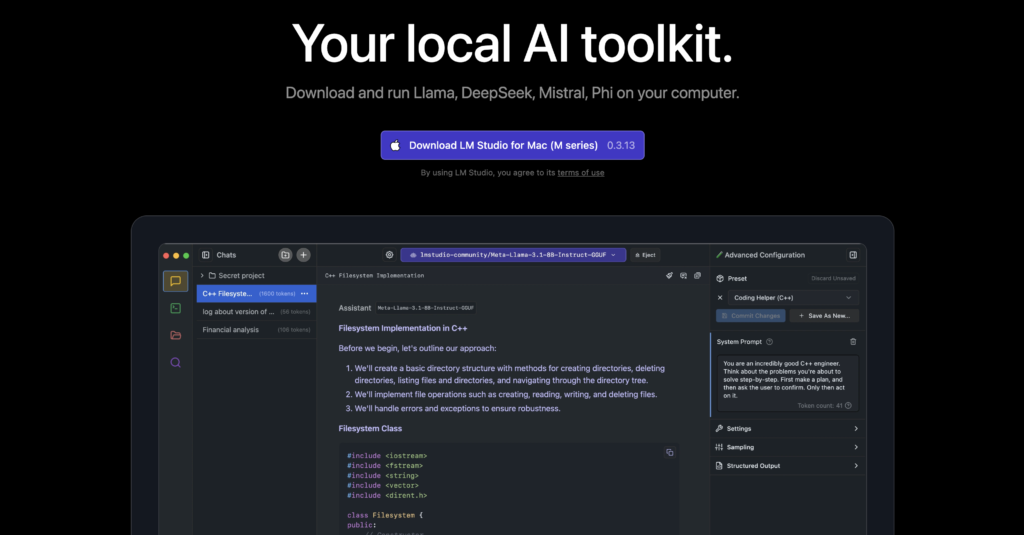

用於本地運行 LLM 模型的替代工具

如果您正在尋找 Ollama 的替代方案,或者從一開始就更喜歡用戶友好的體驗,那麼 LM工作室 這是另一個絕佳的選擇。它提供了一個用戶友好的介面,方便用戶探索和使用各種人工智慧模型,並可輕鬆下載和運行。 LM Studio 支援 Linux、Mac 和 Windows 系統,並提供自訂模型參數和聊天記錄等功能。目前它是免費的,因此我推薦它而不是 Chatbox AI 的訂閱服務。

結論

對於任何希望更好地掌控人工智慧應用並優先考慮資料隱私的用戶來說,在 Mac 本地運行大型語言模型 (LLM) 都至關重要。透過 Ollama 等工具以及前文提到的圖形化前端,您可以輕鬆地將 LLM 整合到工作流程中,從而安全地釋放新的生產力和創造力潛力。

然而,在本地部署 LLM 需要對參數及其如何影響模型在特定機器上的性能有一定的了解。學習這方面知識的最佳方法是嘗試不同的模型,看看哪些模型能帶來最佳效果。一旦了解這個概念,您就能更好地決定使用哪些模型,以及如何優化它們的性能以滿足您的特定需求。

評論被關閉。