如何在 Windows 11 電腦上安裝和使用 Ollama 來執行大型語言模型 (LLM)

在 Windows 機器上本地運行大型語言模型 (LLM) 的方法有很多種,而 Ollama 是其中最簡單、最有效的方法之一。

如今,我們大多數人與人工智慧最常見的互動方式是透過基於雲端的工具,例如: ChatGPT أ或者 副駕駛這些工具需要連接網路才能使用,但優點是幾乎可以在任何裝置上使用。

但並非所有人都希望依賴雲端來運行人工智慧應用,尤其是開發者。因此,他們希望大型語言模型(LLM)能夠在本地設備上運行。 Ollama 正是為此而生的。

Ollama 是一款推理工具,可讓您在電腦上原生運行各種大型語言模型 (LLM)。雖然並非唯一途徑,但它是最簡單直接的方法之一。 Ollama 讓您無需持續的網路連線即可駕馭人工智慧的強大功能,讓您完全掌控自己的資料和隱私。

Ollama及其支援的大型語言模型(LLM)一旦設定完成並運行,您就可以使用它們完成許多操作,但第一步是設定。因此,讓我們一步一步地引導您完成這個過程,以便您能夠充分利用這個強大的工具。

Ollama 操作要求

Ollama 本身運作不會佔用太多系統資源,並且可以在多種裝置上運作。它相容於 Windows 11、macOS 和 Linux。您甚至可以透過 WSL 在 Windows 11 中的 Linux 發行版中使用它。

然而,真正需要更強大硬體的,是運行大型語言模型(LLM)本身。模型越大,所需的處理能力就越強。這些模型需要圖形處理器(GPU)才能運作。目前,它們尚未針對新型 Copilot+ PC 中的神經處理器(NPU)進行最佳化。

幸運的是,有一些小型模型可以在配置一般的硬體上運行。例如,Google的 Gemma 3 模型有一個 1 億參數的版本,運行完整模型僅需 2.3GB 的記憶體。如果升級到 4 億參數的版本,所需的記憶體將超過 9GB。

Meta 的 Llama 3.2 也存在同樣的問題,其 1 億參數模型僅需 4GB 顯存的 GPU 即可成功運作。而 3 億參數模型則需要 8GB 記憶體。

簡而言之,如果您擁有一台相對現代的計算機,配備至少 8GB 記憶體和專用圖形處理單元 (GPU),那麼您應該能夠使用 Ollama。

Windows 11 上的 Ollama 安裝指南

在 Windows 11 上安裝 Ollama 非常簡單;只需下載即可。 請從官方網站安裝該程式 或從 GitHub 儲存庫然後將其安裝到您的裝置上。

簡單來說,步驟如下。

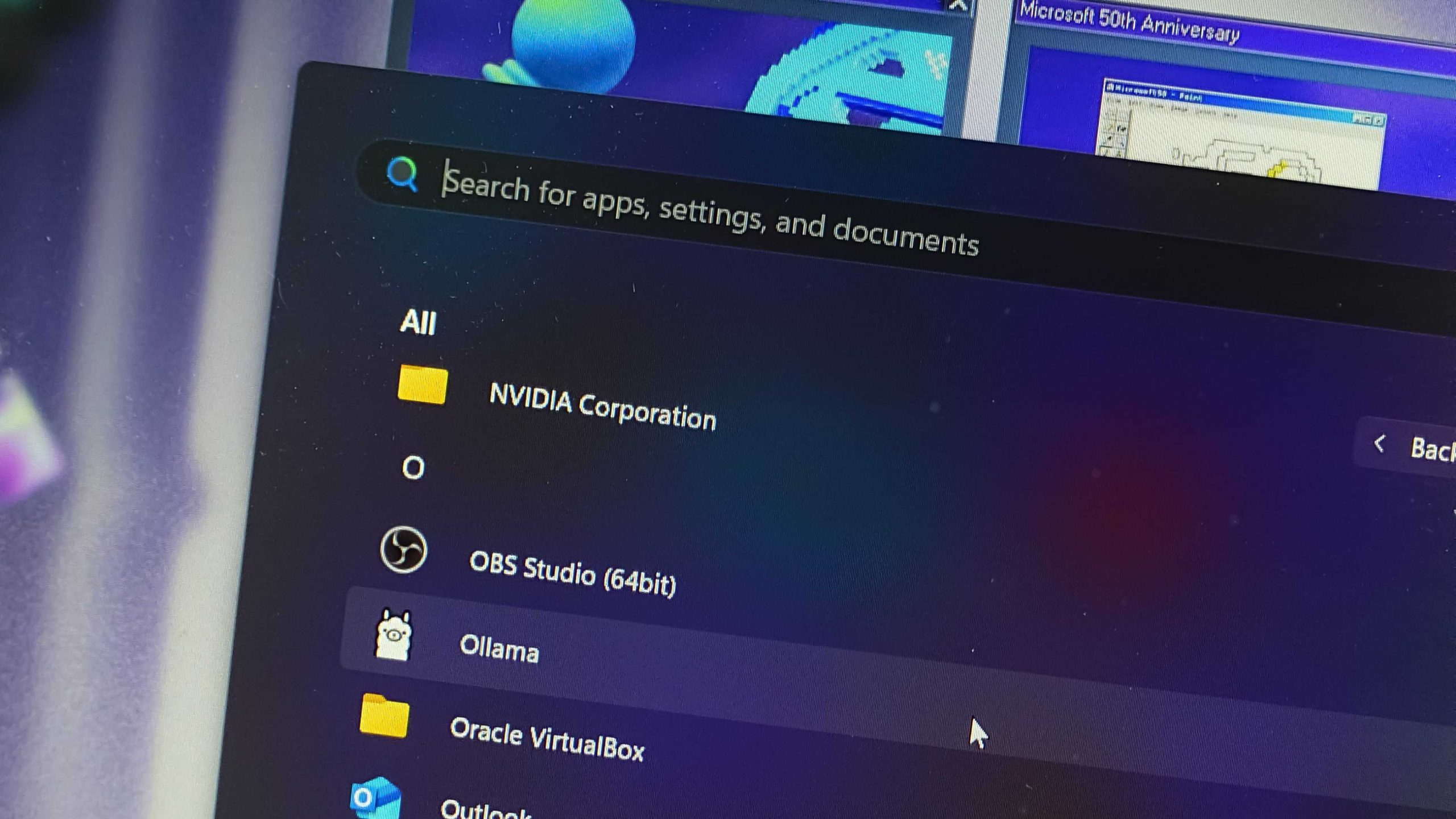

安裝並啟動後,桌面上不會顯示任何內容。程式完全在背景運行,但您可以在工作列中看到它的圖示。

要檢查程式是否正常運行,您可以存取以下地址 本地主機:11434 在您的網絡瀏覽器中。

在 Ollama 上安裝並執行第一個大型語言模型 (LLM)

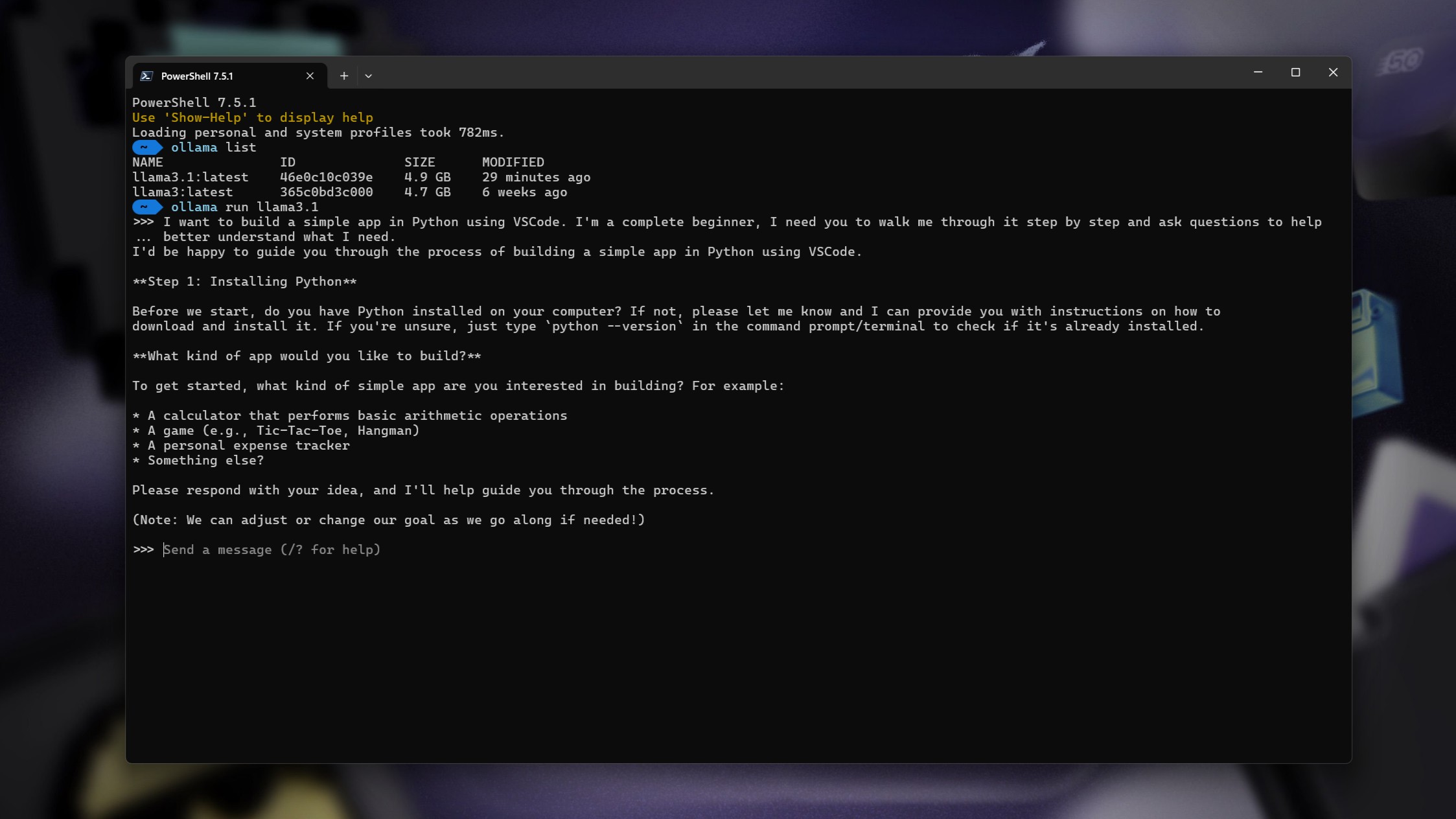

要使用 Ollama 運行您的第一個大型語言模型 (LLM),您主要需要使用命令列介面 (CLI)。在 Windows 上開啟 PowerShell 應用程序,或者如果您已在 WSL 中安裝了 Ollama,則可以使用 WSL。

雖然 Ollama 提供了圖形使用者介面 (GUI),但本文將重點放在命令列用法上。熟悉命令列介面 (CLI) 的使用很有幫助。

你需要知道的兩件主要事情是:

正在運行

奧拉瑪放

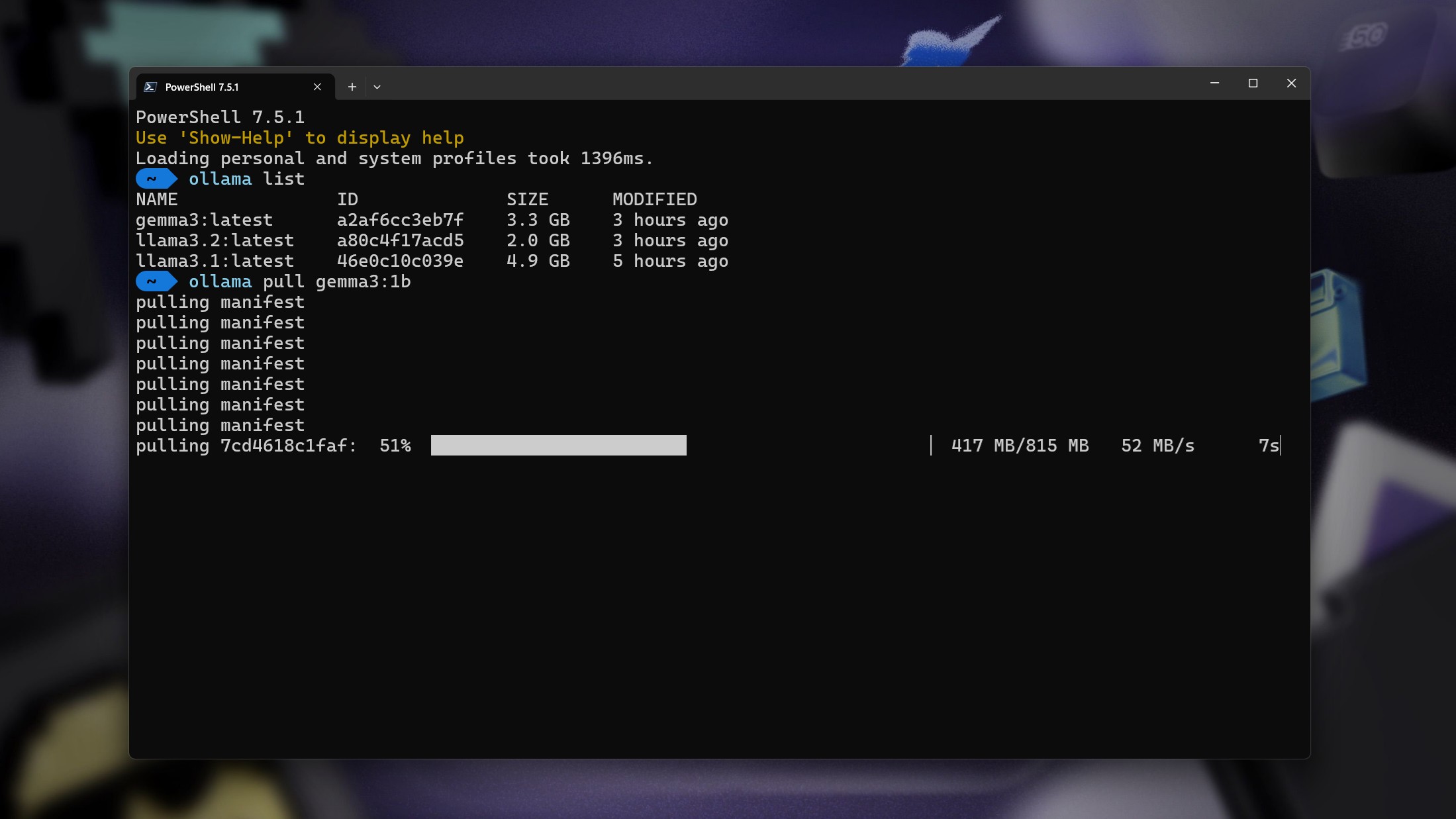

如果您要求 Ollama 執行目前尚未安裝的 LLM 表單,它會自動先下載表單,然後再執行。您可以在 [網站/平台名稱] 上輕鬆找到要安裝的大型語言表單的正確名稱。 Ollama 網站.

例如,要安裝並執行具有 1 億個參數的 Google Gemma 3 LLM 模型,請輸入以下命令:

奧拉瑪跑傑瑪:1b

請注意添加 :1b 在名稱之後,您需要指定要使用的模型具有 1 億個參數。如果您要使用的模型具有 4 億個參數,則需要將其變更為 **:4b**。

在終端設備上運行表單將開啟熟悉的聊天機器人體驗,允許您編寫請求並接收回复,所有操作均在您的設備本地運行。

要退出表單並返回 PowerShell,只需鍵入 **/bye**,進程就會終止。

本文涵蓋了在計算機上設定 Ollama 以使用其可用 LLM 的最基本步驟。基本設定非常簡單易用,幾乎不需要任何技術知識。只要你能做到,你也能做到!

評論被關閉。