兩位專家教你如何辨識媒體對人工智慧的炒作,避免落入「人工智慧騙局」。

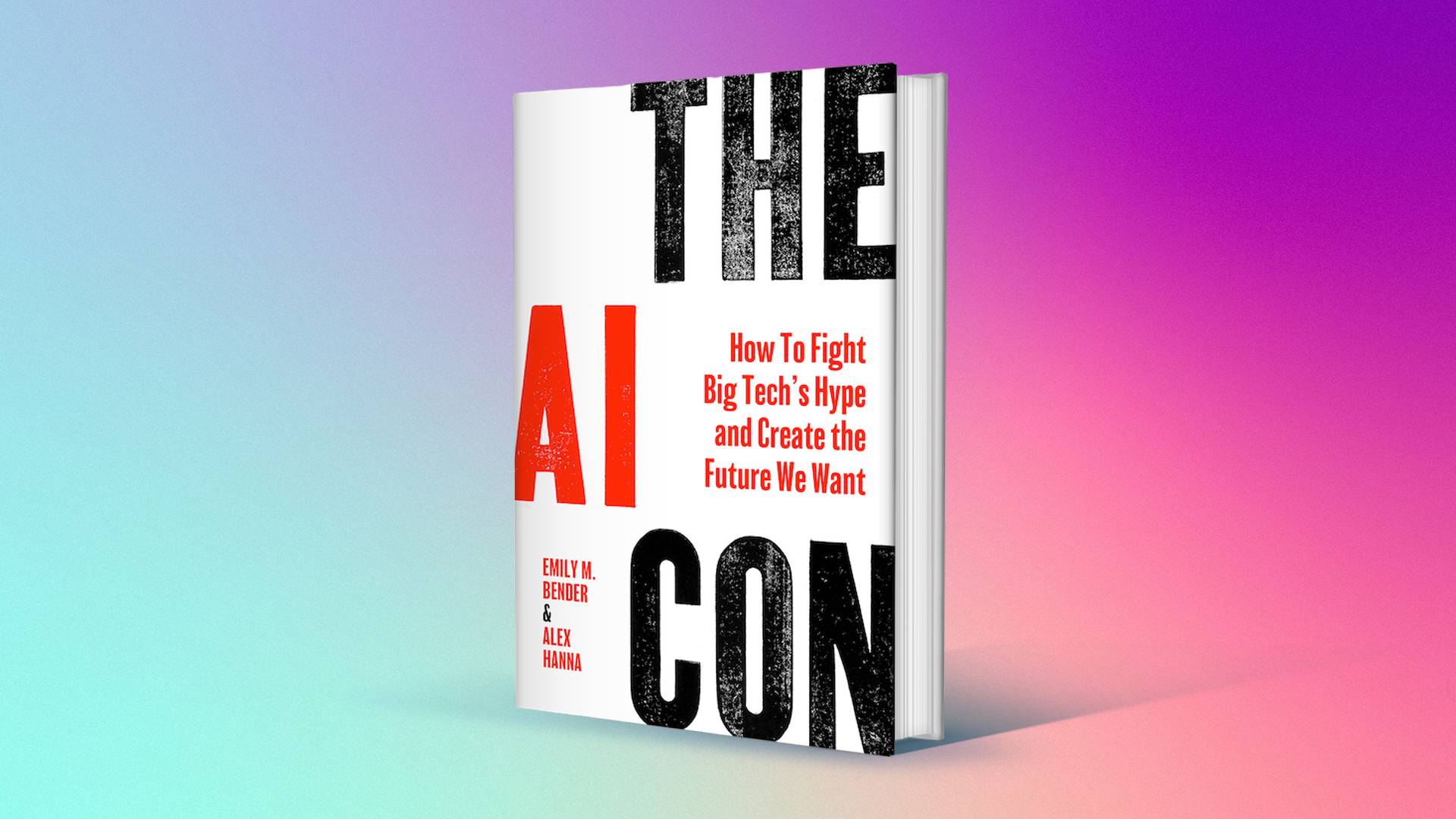

在他們的新書《人工智慧騙局》中,人工智慧批評家艾米麗·本德和亞歷克斯·漢納揭開了生成式人工智慧的神秘面紗。

「坦白說,人工智慧就是一個騙局:一種商品,被賣給你只是為了讓某些人中飽私囊。”

這就是語言學所提出的論點的本質。 艾米莉·本德 還有社會學家 亞歷克斯·漢納 在他們的新書中 人工智慧騙局對於任何生活與人工智慧技術有過交集的人,以及任何質疑過這些技術真正用途的人來說,這都是一本很有幫助的指南——而我們大多數人都是如此。本德是華盛頓大學的教授,曾被《時代》雜誌評為人工智慧領域最具影響力的人物之一;漢娜則是非營利組織的研究主管。 分散式人工智慧研究院 她曾是Google倫理人工智慧團隊的成員。

ChatGPT在2022年底的大規模發布引發了新一輪圍繞人工智慧的媒體炒作。正如作者所定義,媒體炒作是指將一項技術「吹捧」到極致,讓你確信自己需要購買或投資它,「以免錯過樂趣、現金回報、投資收益或市場份額」。但這並非科學家、政府領導人和一般民眾第一次被機器學習和人工智慧的概念所吸引並擔憂,而且很可能也不會是最後一次。

本德和漢娜將機器學習的起源追溯到20世紀50年代,當時數學家約翰·麥卡錫創造了「人工智慧」一詞。在那個時代,美國急於資助任何能夠幫助其在軍事、意識形態或技術上超越蘇聯的計畫。 “它並非憑空而來,”漢娜在接受CNET採訪時表示,“它有著更長的歷史。這當然不是媒體第一次炒作人工智能。”

如今媒體的炒作是由數十億美元的創投所推動的,這些投資流向了像 OpenAI 這樣的新創公司,以及像 Meta、Google和微軟這樣的科技巨頭,它們正投入數十億美元用於人工智慧的研發。結果顯而易見:最新的 電話 筆記型電腦和軟體更新充斥著人工智慧。而且,在各國力圖超越中國人工智慧發展步伐的推動下,人工智慧的研發絲毫沒有放緩的跡象。這並非媒體首次大肆炒作人工智慧。

當然,2025年的生成式人工智慧遠比1970年代首次吸引科學家目光的心理治療聊天機器人Eliza先進得多。如今,企業領導者和員工被媒體炒作、強烈的「害怕錯失良機」心態以及看似複雜卻常被誤用的術語所淹沒。聽信科技領袖和人工智慧愛好者的說法,你可能會覺得人工智慧會搶走你的工作,從而為公司省錢。但作者認為這兩種情況都不太可能發生,而這正是辨識並撥開媒體炒作迷霧如此重要的原因之一。

那麼,我們該如何辨識圍繞人工智慧的媒體炒作呢?根據本德和漢娜的說法,以下是一些明顯的跡象,我們將在下文中分享。兩位作者在他們的著作《Plus》中概述了幾個需要提出的問題以及識別人工智慧媒體炒作的策略。 現已上市 在美國。

注意那些使人工智慧人性化的語言。

人性化,即賦予無生命物體類似人類的品質或特徵,是人工智慧炒作的重要組成部分。人工智慧公司聲稱他們的聊天機器人現在可以“看”和“思考”,就是這種論調的一個例子。

這些比較在描述新型人工智慧程式辨識物件或運用深度推理建構人工智慧模型的能力時或許有用,但它們也可能具有誤導性。人工智慧聊天機器人無法感知或思考,因為它們沒有意識。正如漢娜在我們的訪談和書中指出的那樣,即使是神經網路的概念,也是基於人類在20世紀50年代對神經元的理解,而非神經元實際的工作原理,但它卻可能讓我們誤以為機器背後存在著意識。

這種信念是我們人類與生俱來的,源自於我們處理語言的方式。本德說,我們習慣性地認為,即使我們知道文字是由人工智慧生成的,文字背後仍然有說話者的意識。他補充說:“我們解讀語言的方式是在腦海中建立一個說話者的模型。”

在這些模型中,我們利用對說話者的了解來建構意義,而不僅僅是他們所說的話的含義。 「所以,當我們遇到像 ChatGPT 這樣的工俱生成的文本時,我們也會這樣做,」本德說。 “我們很難提醒自己,那裡面並沒有真正的思維。那隻是我們創造出來的一種概念。”

作者認為,人工智慧公司之所以試圖讓我們相信他們的產品像人類一樣,部分原因是為了最終說服我們相信人工智慧可以取代人類,無論是在工作中還是在創造領域。他們極力鼓吹人工智慧可以成為解決醫療保健和政府服務等關鍵產業複雜問題的靈丹妙藥。

但作者認為,人工智慧往往並非用來解決任何問題。人工智慧被宣傳為提高效率的手段,但最終卻常常用需要低薪合約工或自由工作者精心維護的「黑箱」機器取代熟練工人。正如漢娜在我們的採訪中所說:“人工智慧不會搶走你的工作,但它會讓你的工作變得更糟。”

要謹慎使用「超級智慧」這個詞。

如果人類做不到某件事,就應該對人工智慧能做到的說法保持警覺。漢娜說:「超級智慧或超智慧是一個非常危險的詞,因為它暗示著某種技術會使人類變得多餘。」 「在某些領域,例如大規模模式匹配,電腦確實非常擅長。但如果出現『超級詩歌』、『超級科研理念』或『超級科學實踐』之類的說法,那顯然是行銷。

人們在談論通用人工智慧(AGI)時,常常會提到「超級智慧」的概念。許多高階主管難以準確定義AGI,但它本質上是人工智慧最先進的形式,有可能做出決策並處理複雜任務。目前還沒有證據顯示我們已經接近AGI時代,但它卻是個熱門詞彙。

許多人工智慧領導人物對未來的展望都藉鑒了科幻小說中的比喻。無論是支持者還是悲觀主義者——正如本德和漢娜所描述的那樣,前者是人工智慧的擁護者,後者則擔憂人工智慧可能帶來的危害——都依賴科幻小說中的場景。支持者設想了一個由人工智慧驅動的未來社會。而悲觀主義者則哀嘆人工智慧機器人統治世界並最終毀滅人類的未來。

作者指出,共同點在於人們根深蒂固地認為人工智慧比人類更聰明,而且是不可避免的。 「我們在討論中經常看到的一種觀點是,未來是既定的,問題只在於我們實現它的速度,」本德爾說。 “然後又有人聲稱,這項特定技術是通往未來的一步,而這一切都只是營銷手段。我們需要看穿這些表象。”

人工智慧之所以如此受歡迎,部分原因在於,功能齊全、自主運作的人工智慧助理意味著人工智慧公司正在兌現其對投資者的改變世界的創新承諾。無論未來是烏托邦式的還是反烏托邦式的,對未來的規劃都讓投資者保持前瞻性,而與此同時,企業卻在燒掉數十億美元,並承認自己無法實現碳排放目標。無論好壞,人生並非科幻小說。當有人聲稱他們的人工智慧產品如同電影情節一般時,最好保持懷疑態度。

探究人工智慧的輸入以及如何評估其輸出。

揭露人工智慧行銷假訊息最簡單的方法之一,就是查看公司是否公開其運作方式。許多人工智慧公司不會透露用於訓練模型的內容,但他們通常會披露公司如何處理用戶數據,有時甚至會吹噓其模型如何超越競爭對手。你應該從這裡入手,通常是查看他們的隱私權政策。

創作者們最不滿和擔憂的問題之一是人工智慧模型的訓練方式。目前有大量與涉嫌侵犯版權相關的訴訟,人們也普遍擔憂人工智慧聊天機器人的偏見及其潛在的危害。 「如果你想創建一個旨在推動進步而非重蹈覆轍的系統,就必須從整理數據開始,」本德爾說。然而,漢娜指出,人工智慧公司正在接管「所有原本尚未被納入網路範疇的領域」。

如果你是第一次聽到某個人工智慧產品,那麼你需要特別注意的一點是,它所使用的統計數據是如何凸顯其有效性的。和許多其他研究人員一樣,本德和漢娜指出,任何沒有引用來源的結果都是一個危險信號。 “如果有人向你推銷產品,卻不讓你了解他們的評估方法,”本德說,“那你就得小心了。”

人工智慧公司不願披露其人工智慧產品的工作原理和開發過程等信息,這令人沮喪和失望。雖然掌握這些資訊總是更好,但識別出這些銷售宣傳中的漏洞有助於減少炒作。欲了解更多信息,請參閱“Plus”部分。 ChatGPT 術語表 我們的完整說明以及如何關閉它 蘋果情報.

評論被關閉。