企業人工智慧風險:OpenAI 的替代方案以及人工智慧代理背後的企業

目前人工智慧代理整合過程中的資料隱私、合規性和信任方面的差距

“等等……你們要把帳本條目發送給 OpenAI 嗎?”

當我把東西遞給朋友時,她問的第一件事就是這個。 感受寫作這是一個由人工智慧驅動的日記應用程序,是我在舊金山的黑客馬拉鬆活動中開發的。

她聳了聳肩。

“那是一場以人工智慧為主題的黑客馬拉松,我必須迅速完成一個專案。”

她一刻也沒錯過:

“當然。但我怎麼能相信你們開發的東西呢?為什麼你們不自己託管一個大型語言模型,LLM呢?”

這讓我停了下來。

我為應用開發如此迅速而感到自豪。但那一個問題,以及隨後的問題,讓我徹底看清了自己對如何負責任地運用人工智慧進行開發的所有自以為是。黑客馬拉鬆的評審們也指出了這一點。

那一刻讓我意識到,在使用人工智慧進行開發時,尤其是在使用處理敏感資料的工具時,我們對信任是多麼的漫不經心。

我意識到了一件更重要的事:

我們在建構人工智慧系統時,對信任問題的討論還不夠。

她的回答讓我印象深刻。喬治亞·馮·明登是美國公民自由聯盟(ACLU)的資料科學家,她主要負責處理法律和民權領域中與個人識別資訊相關的問題。我一直很欣賞她的觀點,但這次談話卻有所不同。

所以我請她解釋一下Plus。 在這種情況下,信任的真正意義是什麼? 尤其是在人工智慧系統處理個人資料時。

她告訴我:

「信任難以界定,但數據治理是一個很好的起點。誰擁有數據、如何存儲數據以及數據的用途都至關重要。十年前,我會給出不同的答案。但如今,隨著強大的計算能力和海量數據的湧現,大規模推理已成為一個不容忽視的問題。OpenAI 擁有強大的計算能力和數據資源,但其缺乏透明度,因此謹慎行事是明智之舉。」

「就個人識別資訊(PII)而言,無論是法規還是常識都表明,強有力的數據治理至關重要。在API調用中發送個人身份信息不僅風險極高,而且可能違反相關規定,使個人面臨風險。”

這讓我意識到,當我們使用人工智慧進行建置時,特別是處理敏感人類資料的系統時,我們不僅僅是在編寫程式碼。

我們對隱私、權威和信任做出決定。

當你收集用戶數據,尤其是像日記這樣私密的數據時,你就肩負起了相應的責任。這不僅關乎你的模型能做什麼,更關乎這些數據的去向、去向以及誰有權訪問。負責任地管理用戶資料能夠提升用戶信任度,並加強隱私保護。

簡單的錯覺

如今,推出看似智慧的產品比以往任何時候都更容易。透過 OpenAI 等大型語言模型 (LLM),開發者只需幾個小時就能建立出人工智慧工具。新創公司一夕之間就能推出人工智慧驅動的功能。而企業呢?他們正爭先恐後地將這些智能體整合到工作流程中。

但在所有這些熱情之中,有一件事常常被忽略: 相信.

當人們談論 人工智慧代理(AI代理)他們通常指的是圍繞大型語言模型(LLM)的簡單封裝。這些代理可以回答問題、自動執行任務,甚至做出決策。但許多代理商都是倉促建構的,很少關注安全性、合規性或問責制。

僅僅使用產品 OpenAI 但這並不意味著它是安全的。你真正信任的是整個管道:

- 誰製作了封面?

- 你們如何處理數據?

- 你的資訊是否被儲存或記錄——或者更糟的是,是否被洩露?

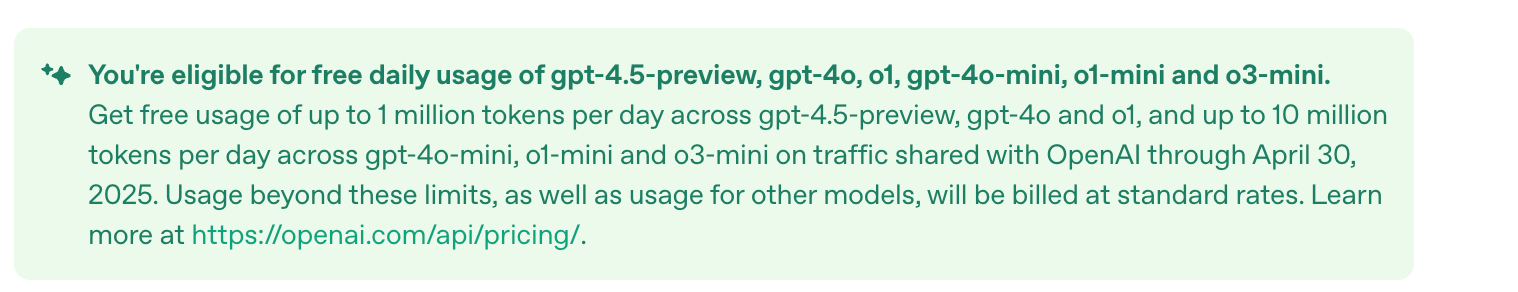

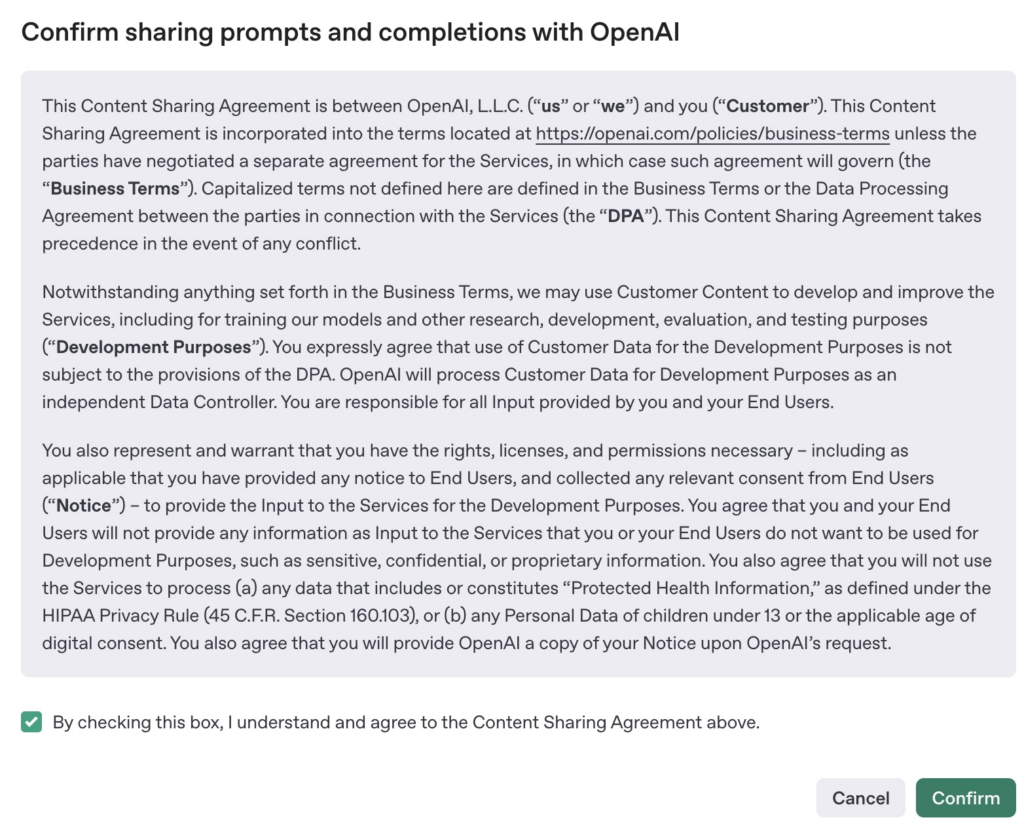

我自己也一直在使用 OpenAI 的 API 來處理客戶專案。最近,我獲得了免費使用 API 的機會——每天最多可以產生 1 萬個令牌,直到四月底—— 如果您同意分享我的索賠數據.

我差點就同意了,畢竟這只是個個人專案。但後來我意識到:如果一家解決方案提供者為了降低成本而接受同樣的協議,那麼他們的用戶根本不會知道自己的資料正在被共享。從個人角度來看,這或許看似無害。但在組織層面呢?這嚴重侵犯了用戶的隱私,而且可能違反了合約或監管義務。

只要有一個工程師對這樣的交易說“是”,你客戶的資料就會落入別人手中。

企業人工智慧提高了人們的期望

我看到越來越多的SaaS公司和開發工具新創公司正在嘗試使用AI代理。一些公司取得了不錯的成果,某些AI代理允許使用者匯入自己的大型語言模型(LLM),從而控制模型的運行位置和資料處理方式。鑑於AI在企業中的重要性日益凸顯,這無疑是個明智的做法。

這是經過深思熟慮的方法: 信任的界線由你設定。.

但並非每個人都如此謹慎。

許多公司只需連接到 OpenAI 的 API,增加幾個按鈕,就稱之為「企業級」解決方案。

警告:這並非事實。

會出什麼問題呢?很多問題。

如果你在沒有提出關鍵問題的情況下就將人工智慧代理整合到你的基礎設施中,那麼可能會面臨以下潛在風險:

- 資料外洩您的索賠可能包含敏感的客戶資料、API 金鑰或內部邏輯—如果將其發送到第三方表單,則可能會洩露。

2023年,三星工程師無意中將內部原始碼和筆記貼到了ChatGPT中(福布斯這些數據現在可能成為未來訓練集的一部分——這對智慧財產權構成重大風險。

- 違規行為透過 OpenAI 等表單提交個人識別資訊 (PII) 而沒有適當的控制措施,可能會導致違反一般資料保護規範 (GDPR)、HIPAA 法或您的合約。

伊隆馬斯克的公司X就為此付出了慘痛的代價。他們推出人工智慧聊天機器人「Grok」時,使用了所有用戶的帖子,包括歐盟用戶的帖子,卻缺乏適當的監管。監管機構迅速介入,並在壓力下叫停了Grok在歐盟的訓練。政治).

- 模稜兩可的行為非確定性智能體難以修正或解釋。當客戶詢問聊天機器人為何給予錯誤推薦或洩漏機密資訊時,該怎麼辦?你需要透明度來回答這個問題——而如今許多智能體都無法做到這一點。

- 資料所有權方面的混亂誰擁有輸出結果?誰記錄數據?服務提供者是否會根據你的輸入進行重新訓練?

Zoom 在 2023 年就被發現做了這件事。他們悄悄地修改了服務條款,允許使用客戶會議資料來訓練人工智慧。快公司在遭到公眾強烈反對後,他們撤回了這項政策,但這提醒人們,信任可能在一夜之間就失去殆盡。

- 包裝安全漏洞2024 年,數十個 Flowise 部署(一種流行的低程式碼 LLM 格式化工具)被發現暴露在網路上,其中許多沒有身份驗證。網絡安全新聞研究人員發現API金鑰、資料庫憑證和使用者資料遭到外洩。這並非OpenAI的問題,而是整個產業的問題。 建築商但最終付出代價的還是終端用戶。

- 人工智慧功能過度微軟的「Recall」功能(作為其 Copilot 推廣計畫的一部分)會自動擷取使用者活動的螢幕截圖,以幫助 AI 助理回答問題。雙脈衝星它看起來很有用……直到安全專家指出它會造成隱私隱患。微軟被迫迅速做出調整,將此功能改為可選。

並非所有事物都需要OpenAI。

OpenAI是一個功能極為強大的平台,但它並非總是理想的解決方案。

有時,規模較小的本地模型就完全足夠了。有時,基於規則的邏輯效果會更好。而通常情況下,最安全的選擇是完全在您自己的基礎設施內,按照您制定的規則運行的模型。

我們不應該盲目地插入大型語言模型(LLM)就稱之為「智慧助理」。

在機構中, 信任、透明和控制並非可有可無的附加條件。 ——相反,這至關重要。

越來越多的平台提供這種控制功能。 Salesforce 的 Einstein 1 Studio 現在也支援此功能。 自帶模型這使您能夠連接來自 AWS 或 Azure 的大型語言模型 (LLM)。 IBM Watson 讓組織能夠在內部部署模型,並提供完整的稽核追蹤。 Databricks 及其 MosaicML 功能可讓您在雲端訓練私有的大型語言模型 (LLM),從而確保您的敏感資料永遠不會離開您的基礎架構。

這才是真正的企業級人工智慧該有的樣子。

結論

人工智慧代理功能強大,能夠實現以前無法實現的工作流程和自動化。然而,它們易於開發並不一定能保證其安全性,尤其是在大規模處理敏感資料時。

在使用這種新型清潔劑之前,請先問問自己:

- 誰控制這個模型?

- 資料會傳輸到哪裡?

- 我們是否遵守相關規定?

- 我們可以仔細檢視他的行為嗎?

在人工智慧時代,最大的危險不是糟糕的技術,而是… 盲目信任。

關於作者

我是艾琳,一名擁有6年經驗的機器學習工程師,目前在舊金山一家金融科技新創公司工作。我的背景包括在石油和天然氣諮詢行業擔任數據科學職位,以及領導亞太、中東和歐洲地區的人工智慧和數據培訓專案。

我目前正在攻讀資料科學碩士學位(將於2025年5月畢業),並積極尋找機器學習工程師的職位。如果您願意提供推薦或人脈資源,我將不勝感激!

我喜歡透過人工智慧對世界產生真正的影響,我也一直樂於參與基於專案的合作。

評論被關閉。