人工智慧模型:功能強大,但在電玩產業卻有所欠缺

隨著人工智慧工具的不斷發展,我們不斷被鼓勵將越來越複雜的任務委託給它們。大型語言模型(法學碩士撰寫電子郵件、製作簡報、設計應用程式、製作影片、搜尋網路並總結結果等等,她都能勝任。然而,有一件事她仍然覺得極具挑戰性,那就是玩電子遊戲。

今年以來,兩家最大的人工智慧公司(微軟和Anthropic)都試圖讓他們的模型來創建或玩遊戲,但結果可能遠不如許多人預期的那麼理想。這凸顯了生成式人工智慧目前面臨的挑戰,尤其是在需要長期策略規劃和複雜決策的任務方面。

這使得它們成為生成式人工智慧當前真正意義的理想例證——簡而言之:它比以前能做的事情多得多,但並非無所不能。這反映出生成式人工智慧仍處於發展階段,儘管其能力不斷增強,但在某些領域仍存在局限性。

微軟正在開發一款融入人工智慧的《雷神之鎚2》。

電子遊戲製作面臨著與影片製作類似的挑戰,例如動作往往不穩定且失真,以及人工智慧在一段時間後會逐漸脫離現實。微軟最新的嘗試… 任何人都可以嘗試這是人工智慧生成的版本 雷神之鎚II.

我玩了好幾遍這款遊戲,體驗真是十分詭異。敵人會莫名其妙地出現,周圍的環境也會隨著你的移動而改變。很多時候,當我進入一個新房間時,轉身面對門口,門卻消失了;而當我再次看向前方時,牆壁又會移動。

體驗只會持續幾分鐘,然後就會停止並提示你開始新遊戲,但如果你運氣不好,甚至在此之前它就可能停止正確回應你的輸入。

然而,這的確是一次絕妙的體驗,我認為讓更多人看到它會很有好處。它能讓你親身感受生成式人工智慧的能力以及它目前的限制。雖然我們能夠創造出如此互動性強的電子遊戲體驗令人印象深刻,但很難想像任何體驗過這項技術演示的人會相信下一部《刺客信條》遊戲會由人工智慧生成。

然而,這類觀點和假設之所以存在,很大程度上是因為人們現在無時無刻都在談論人工智慧。即便你對人工智慧完全不感興趣,它也會無所不在地出現在你的生活中。問題在於,一般人接收到的訊息幾乎完全來自大型科技公司的行銷宣傳和新聞媒體轉載的高階主管評論。

這意味著他們會聽到類似這樣誇張且自相矛盾的說法:

他有潛力解決一些世界重大問題,例如氣候變遷、貧窮和疾病。بيلغيتس)

到 2025 年,我們 Meta 公司以及其他主要從事這方面研究的公司很可能會擁有人工智慧,它可以像貴公司的中級工程師一樣工作,並能有效地編寫程式碼。馬克·扎克伯格)

在 Shopify,有效利用人工智慧如今已成為每個人的基本要求。它已成為當今各行各業的工具,而且其重要性只會與日俱增。坦白說,我認為在工作中,沒有人能夠避免學習如何應用人工智慧。托比·洛特克(Shopify執行長)

我們現在確信,我們已經掌握了建構傳統意義上的通用人工智慧(AGI)的方法。我們相信,到2025年,我們或許會看到首批人工智慧代理商“加入勞動力市場”,並從根本上改變企業的生產力。山姆·奧特曼OpenAI執行長

人工智慧比飛機設計缺陷、生產維護不當或生產有缺陷的汽車等問題更危險,因為它有可能——儘管機率很小,但並非微不足道——摧毀文明。伊隆麝香)

這一切聽起來是不是有點誇張?它既要拯救我們,又要毀滅我們;它既是專業人士的一站式工具,又要取代他們——而且看起來我們最早今年就能用上科幻小說裡那種級別的通用人工智慧(AGI)。人們一聽到這些,就開始對這些設備抱有不切實際的幻想,甚至覺得所有上班族都像《星際爭霸戰》裡的角色一樣,整天跟電腦對話。

然而,現實並非如此。現實就像一款搖搖晃晃、笨拙不堪的《雷神之鎚2》,敵人的外型令人難以辨認。 ChatGPT級別的LLM模型在2022年的確是一項令人興奮的突破,也讓每個人都樂在其中——但對於大型科技公司現在強加給我們的絕大多數應用而言,人工智慧的能力遠遠不夠。準確率太低,指令執行能力太差,上下文理解範圍太窄,而且它僅基於網路上的無意義資訊進行訓練,而非現實世界的知識。

但製作電子遊戲是一項極其複雜的工作——畢竟,這需要整個團隊花費數年才能完成。那麼,玩電子遊戲又如何呢?

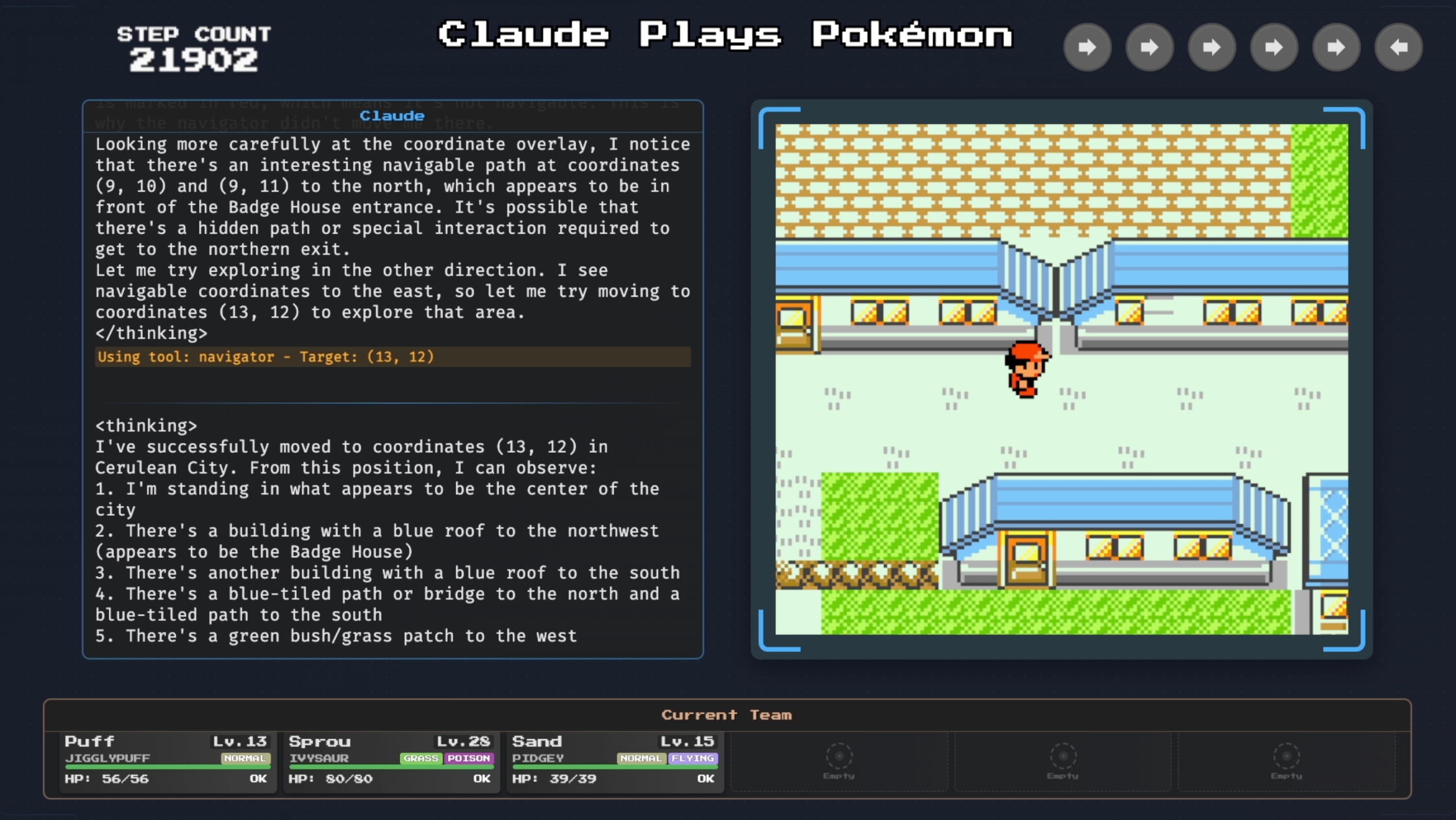

克勞德玩《精靈寶可夢 紅》

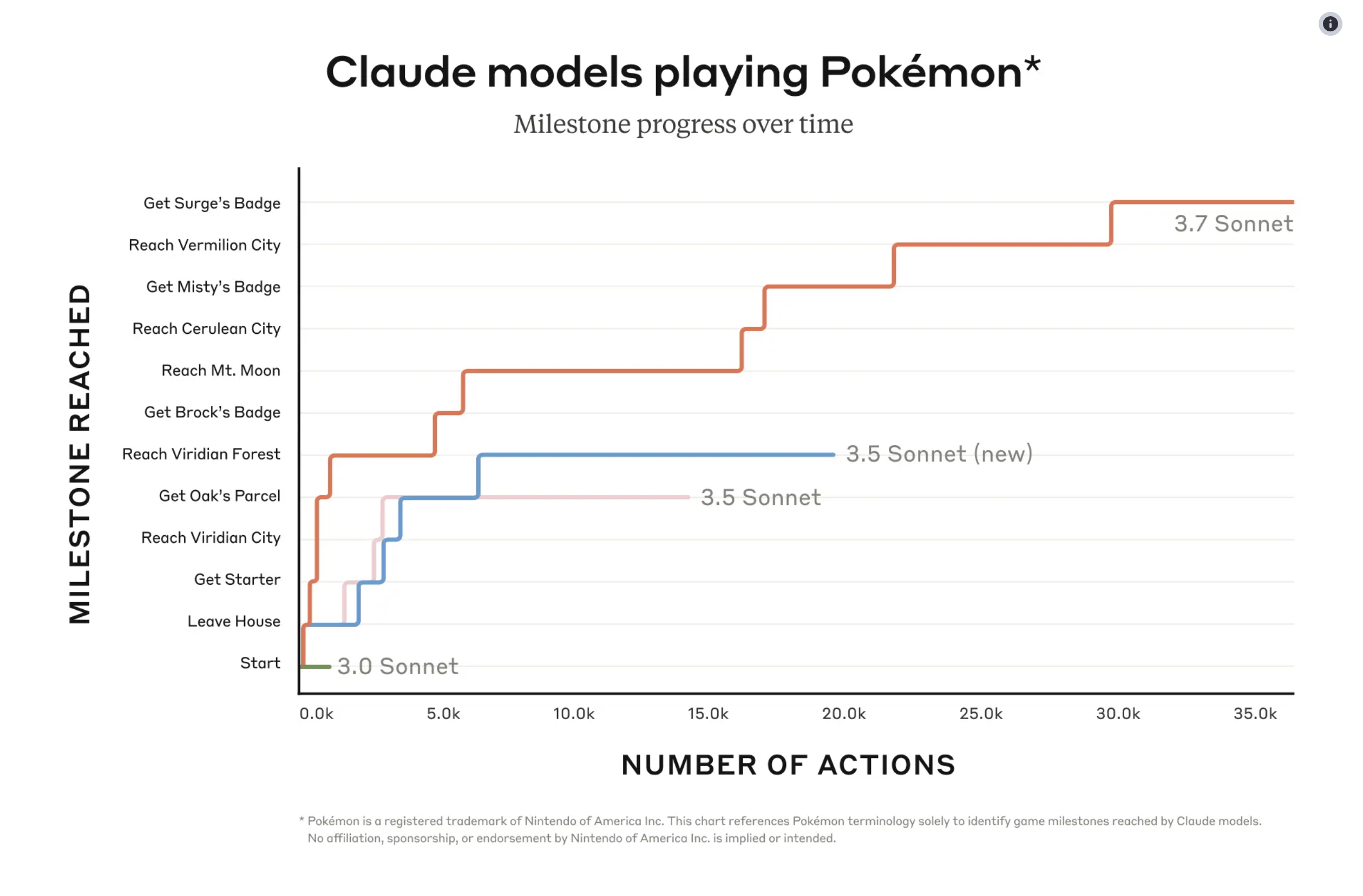

原來,也有人在做這方面的實驗。 Anthropic 最新款的產品就是其中之一。 克勞德第 3.7 首十四行詩 他玩 在 Twitch 上玩 Pokémon Red 近兩個月來,他在玩寶可夢方面表現出色,堪稱大型語言模型(LLM)的巔峰之作。然而,需要指出的是:他的水平仍然遠不及普通10歲兒童。

速度是其中一個問題——克勞德需要花費數天時間執行數千次操作才能完成諸如穿越翠綠森林之類的任務。這反映了人工智慧在處理複雜任務時所面臨的挑戰。

為什麼這麼久?並非因為他不會策略性地贏得寶可夢對戰——事實上,這正是他的強項。另一方面,在複雜環境中穿梭、避開樹木和建築物並非他的強項。克勞德從未接受過寶可夢對戰的訓練,要理解像素藝術及其意義對他來說並非易事。這些困難凸顯了他的數據處理能力與應對複雜環境能力之間的差距。

對他來說,在像月見山這樣迷宮般的區域穿梭尤其困難,因為他既要努力繪製地圖,又要避免被追蹤。有一次,他被逼到了絕境,甚至認為遊戲出了故障,並正式要求重置遊戲。這說明,儘管人工智慧擁有先進的功能,但它仍然缺乏人類所具備的直覺理解力。

這些早期的嘗試也並非沒有一些搞笑的時刻。

有一次,克勞德陷入了困境,他確信遊戲出現了某種故障,於是寫了一份正式的請求,要求重置遊戲。 pic.twitter.com/5RIiCJdxCM— 人擇 (@AnthropicAI) 2025 年 2 月 25 日

他也不太擅長記住自己的目標、已經嘗試過的事情或以前去過的地方。

原因很簡單——大型語言模型(LLM)的「上下文視窗」有限,它相當於自己的記憶體。它們只能儲存一定程度的信息,一旦克勞德達到容量上限,就會壓縮已有資訊以騰出空間儲存更多內容。因此,像「參觀了翠綠城,進入了所有建築,並與所有NPC交談」這樣的訊息可能會被壓縮成「訪問了翠綠城」——這就會促使克勞德返回翠綠城,看看是否還有其他事情可做。

簡而言之:克勞德找不到方向,他會撞牆,會把隨機物體誤認為是非玩家角色(NPC),他會忘記自己身在何處以及想要做什麼,而且他做的每一個決定都需要花費大量時間思考。這並非批評——這些都是令人興奮的實驗,旨在將大型語言模型(LLM)的表現推向極限。

但鑑於人工智慧(AI)目前被炒作得沸沸揚揚,人們觀看這類演示並形成自己對AI的看法至關重要。有些人試圖宣揚我們即將達到巔峰——幾年之內,AI甚至會超越最聰明的人類——但我認為他們並不誠實;他們只是推銷員。我們離巔峰還很遠;這一切才剛開始。

評論被關閉。