AI 愛好者所需的手機秘密:將 Gemini 和 ChatGPT 發揮到極致

過去兩年,智慧型手機產業最引人注目——坦白說,也是最無聊的——趨勢之一,就是對人工智慧 (AI) 體驗的不斷討論。尤其是晶片公司,他們經常吹噓自己最新的行動處理器將如何支援設備上的 AI 操作,例如影片創作。

我們已經實現了這個目標,儘管還沒有完全實現。在圍繞著各種人工智慧技巧的炒作中,智慧型手機用戶對人工智慧的熱情時好時壞,討論的焦點很少超出新處理器的炫目展示和不斷發展的聊天機器人。

直到Google Pixel 8 缺席 Gemini Nano 處理器引發爭議後,大眾才意識到運行記憶體容量對於行動裝置 AI 至關重要。蘋果也很快澄清,Apple Intelligence 將鎖定在至少配備 8GB 運行記憶體的裝置。這項決定反映了運行記憶體對於高效運行 AI 模型的重要性。

但「AI 手機」的形像不僅取決於記憶體容量。你的手機在 AI 任務中的表現如何,除了儲存空間之外,還取決於隱形的運行記憶體 (RAM) 改進。而且,我說的不只是容量。

記憶體創新正在應用於人工智慧手機。

Digital Trends 採訪了全球領先的記憶體和儲存解決方案供應商美光科技 (Micron),分析了隨機存取記憶體 (RAM) 和儲存在智慧型手機 AI 中的作用。下次購買高階手機時,美光科技的先進技術值得關注。

這家總部位於愛達荷州的公司的最新產品包括用於旗艦智慧型手機的 G9 NAND 行動 UFS 4.1 儲存和 1γ(1-gamma)LPDDR5X RAM 模組。那麼,除了增加容量之外,這些記憶體解決方案還能如何推動智慧型手機的 AI 發展呢?

我們先從G9的NAND UFS 4.1儲存解決方案開始。 主要承諾是經濟的功耗、減少的延遲和高頻寬。UFS 4.1 標準可以達到 4100MB/s 的峰值順序讀寫速度,比 UFS 4.0 世代提高了 15%,同時也降低了延遲數字。

另一個關鍵優勢是美光新一代便攜式儲存設備的容量高達 2TB。此外,美光還能夠縮小其尺寸,使其成為下一代可折疊和輕薄手機的理想解決方案,例如 三星Galaxy邊緣S25.

在 RAM 方面,美光科技開發了所謂的 1γ LPDDR5X RAM 模組。它們的最高速度可達 9200 MT/s,由於尺寸減小,電晶體數量可增加 30%,功耗降低 20%。美光科技已在三星 Galaxy S25 系列智慧型手機中推出了速度稍慢的 1β(1-beta)RAM 解決方案。

儲存與人工智慧的互動

美光行動業務部產品行銷總監 Ben Rivera 解釋道,美光在其最新儲存解決方案中引入了四項關鍵改進,以確保在行動裝置上實現更快的 AI 運作。這些改進包括分區 UFS、資料碎片整理、固定寫入助推器 (Pinned WriteBooster) 和智慧延遲追蹤器 (Intelligent Latency Tracker)。

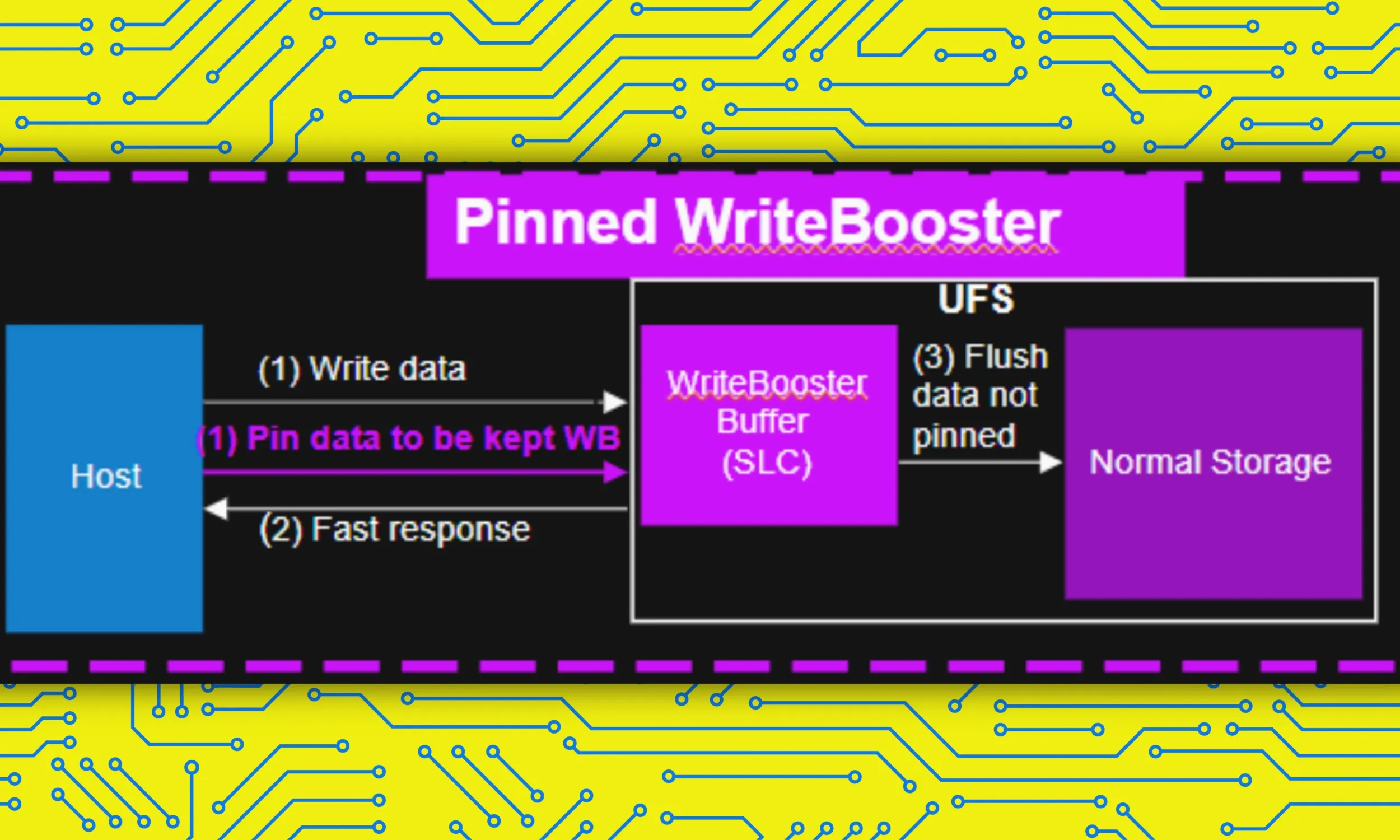

「此功能使處理器或主機能夠識別並隔離或『固定』智慧型手機中最常用的資料到儲存裝置中稱為 WriteBooster 緩衝區(類似於快取)的區域,以便能夠快速、立即存取它,」Rivera 在解釋 Pinned WriteBooster 功能時說道。

每個試圖在裝置上執行任務的 AI 模型(例如 Google Gemini 或 ChatGPT)都需要一套儲存在行動裝置本地的指令檔案。例如, Apple Intelligence 高達 7GB 的儲存空間 對於其所有操作。

要執行一項任務,您不能將整個 AI 堆疊委託給 RAM,因為它需要空間來處理其他關鍵任務,例如撥打電話或與其他關鍵應用程式互動。為了解決美光儲存的限制,我們創建了一個記憶體映射,只將所需的 AI 權重從儲存載入到 RAM。

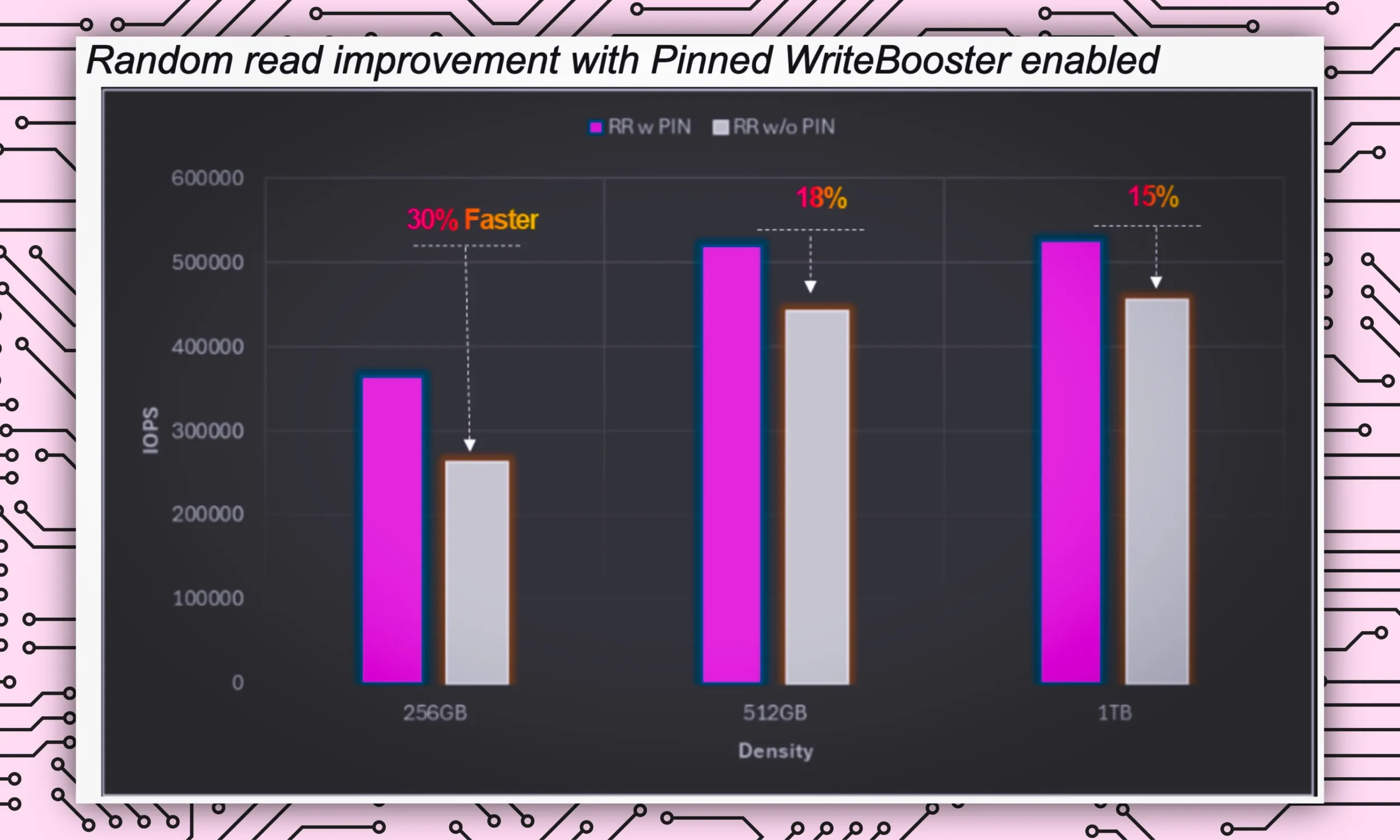

當資源受限時,您需要更快的資料交換和讀取速度。這可確保您的 AI 任務在執行時不會影響其他關鍵任務的速度。透過 Pinned WriteBooster,資料交換速度可提升 30%,確保 AI 任務無延遲處理。

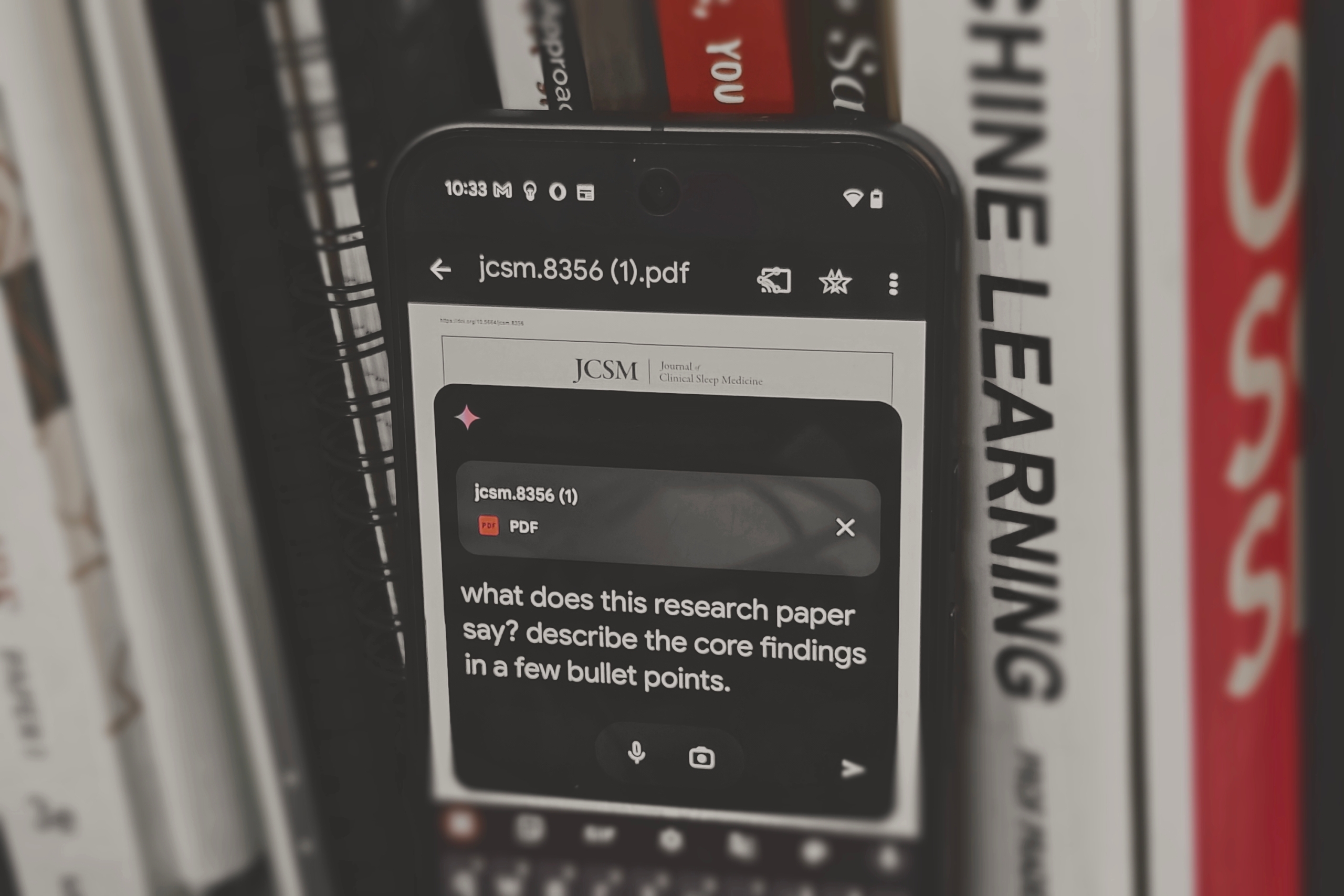

假設你需要 Gemini 提取 PDF 檔案進行分析快速記憶體交換可確保所需的 AI 權重快速從記憶體傳輸到 RAM。

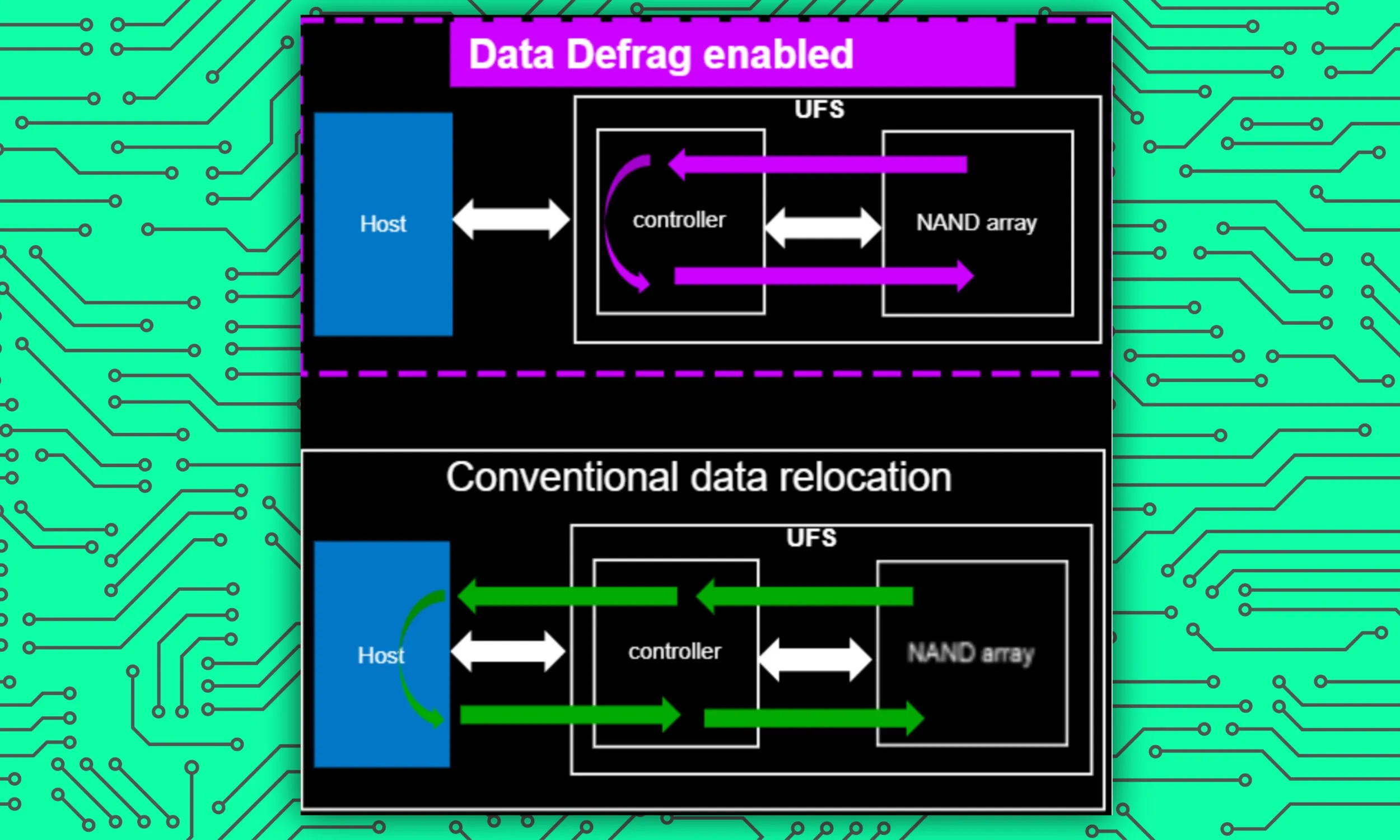

接下來介紹資料碎片整理。你可以把它想像成一個桌面或衣櫃整理器,確保物品按不同類別整齊地分組,並放置在各自的隔間中,方便查找。

在智慧型手機領域,雖然在長期使用過程中會儲存大量數據,但這些數據通常以某種隨機的方式儲存。最終的結果是,當機載系統需要存取特定類型的文件時,查找所有文件會變得更加困難,從而導致運行速度變慢。

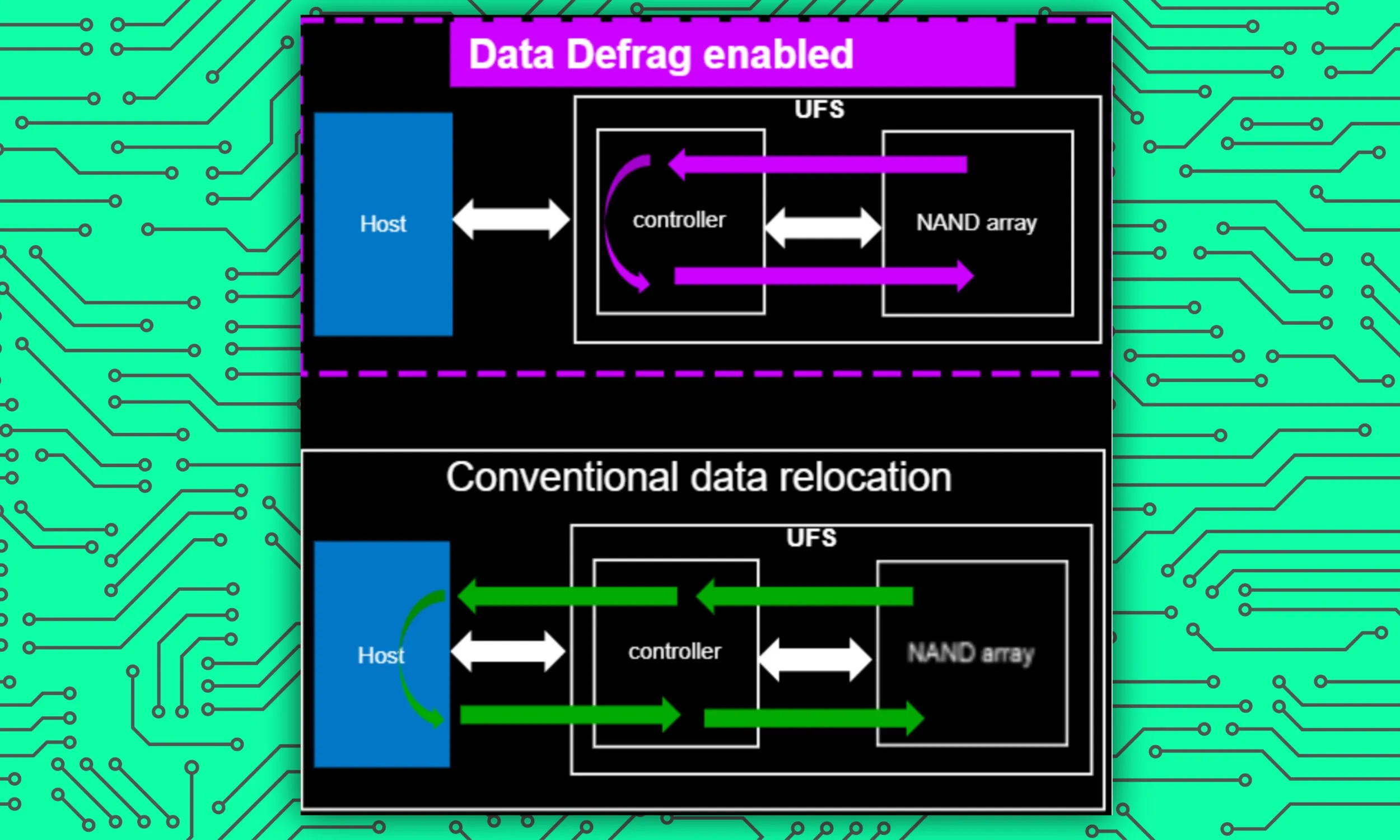

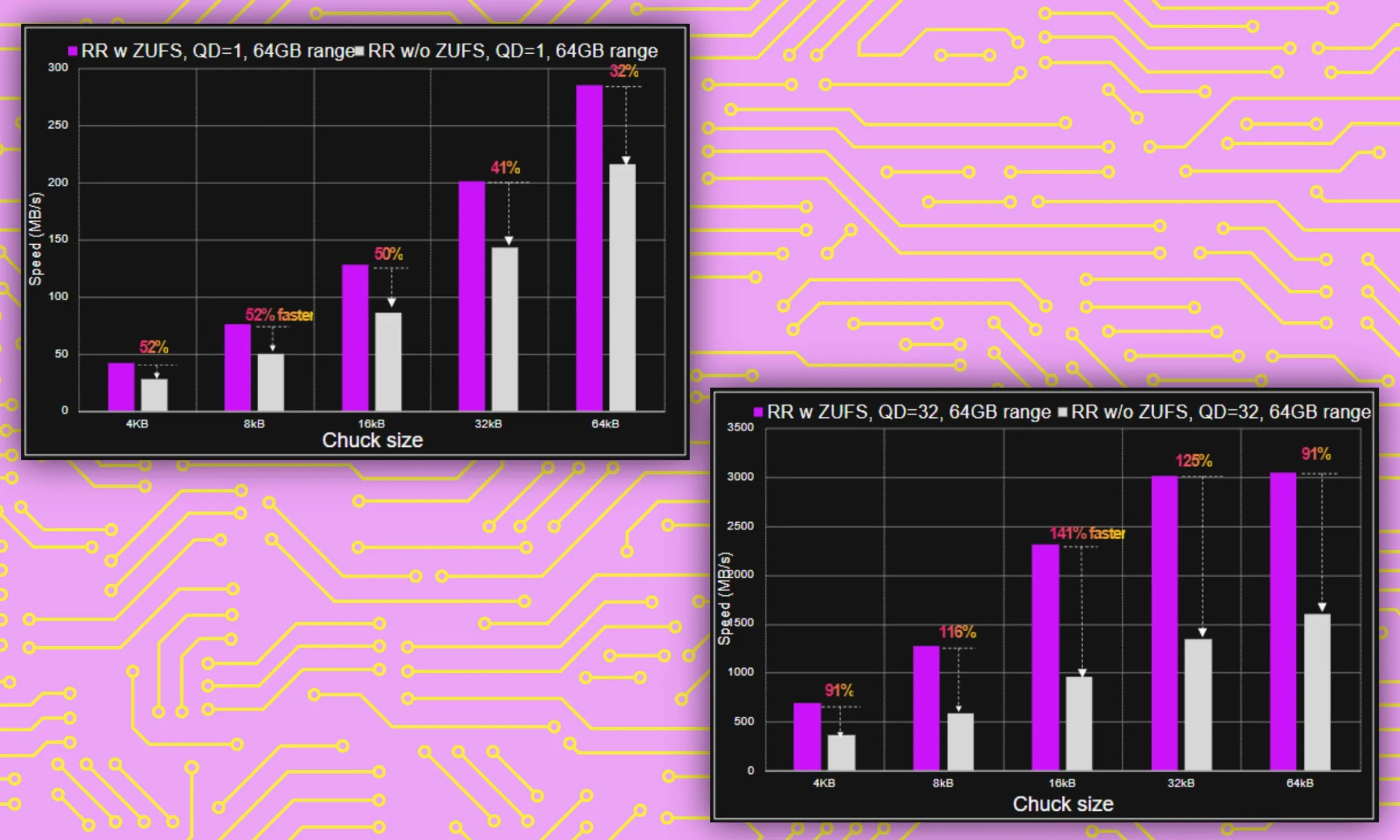

Rivera 表示,Data Defrag 不僅有助於有序儲存數據,還能改變儲存裝置與裝置控制器之間的互動。因此,它 資料讀取速度提高 60%,自然加速所有類型的用戶設備交互,包括AI任務。

美光公司的一位官員告訴 Digital Trends:“此功能可以幫助加速 AI 功能,例如當生成 AI 模型(例如用於從文本提示生成圖像的模型)從存儲調用到內存時,可以更快地將數據從存儲讀取到內存。”

智慧延遲追蹤器是另一項功能,主要監控延遲事件以及可能降低手機正常速度的因素。它有助於糾正錯誤並提升手機效能,確保常規任務和 AI 任務不會遇到速度障礙。

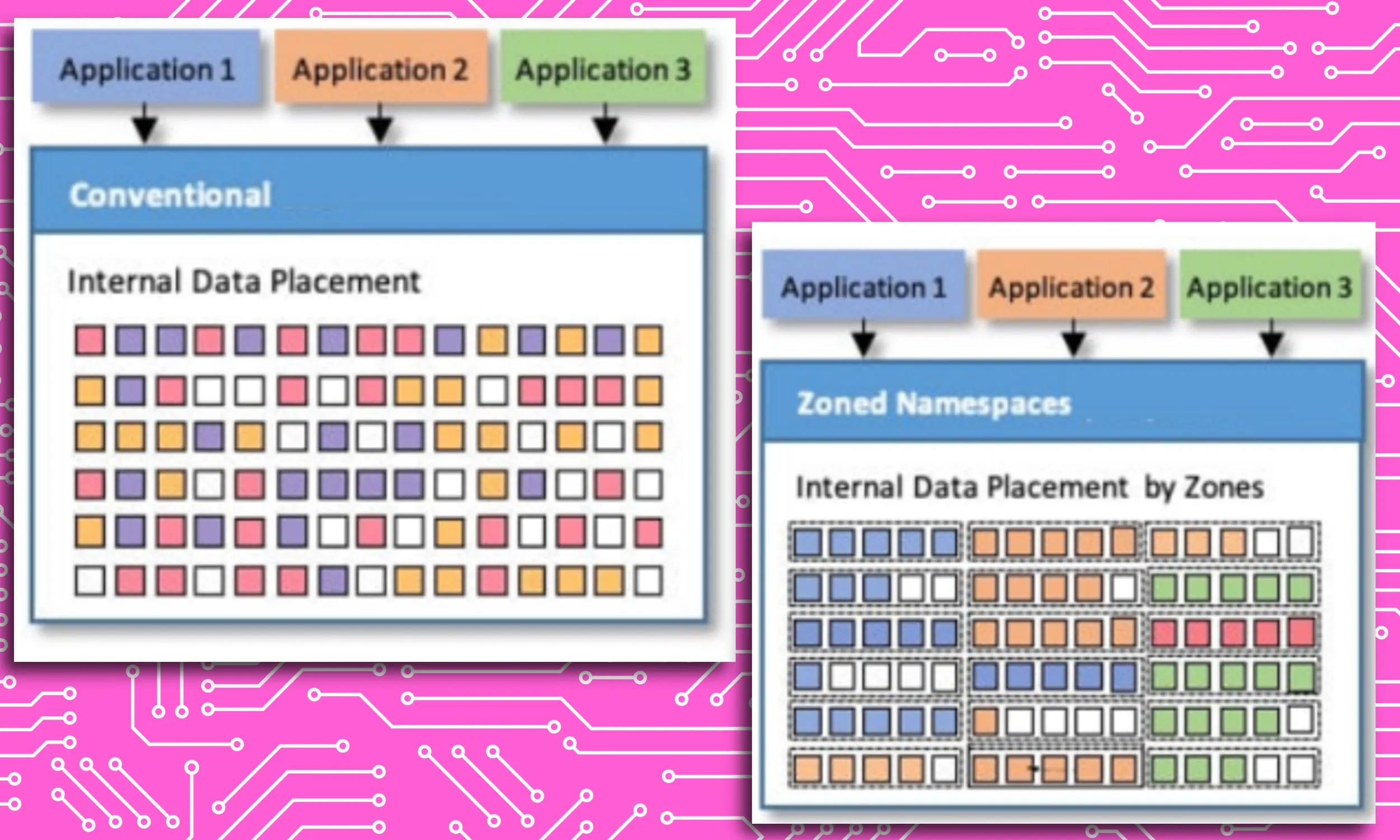

最後一個儲存增強功能是分區 UFS。此系統確保具有相似輸入/輸出特性的資料以有序的方式儲存。這一點至關重要,因為它使系統更容易找到所需的文件,而無需浪費時間搜尋所有資料夾和目錄。

「美光的 ZUFS 功能有助於組織數據,以便當系統需要為某項任務定位特定數據時,過程更快、更順暢,」Rivera 告訴我們。

RAM 溢出

說到 AI 工作流程,你需要一定數量的 RAM。 RAM 越大越好。雖然 Apple 已將其 Apple Intelligence Suite 的基準記憶體設定為 8GB,但 Android 生態系統中的玩家已將記憶體升級至 12GB 作為安全預設配置。這是為什麼呢?

「AI 體驗也需要大量數據和能源,」Rivera 解釋道。 “因此,為了兌現 AI 的承諾,內存和存儲必須提供低延遲、高性能和最高的能源效率。”

憑藉其面向智慧型手機的新一代 1γ (1-gamma) LPDDR5X DRAM 解決方案,美光科技已能夠大幅降低記憶體模組的工作電壓。接下來是至關重要的本地效能問題。 Rivera 表示,新的記憶體模組運行速度高達每秒 9.6 Gb,確保卓越的 AI 效能。

美光公司表示,其極紫外 (EUV) 微影製程的改進不僅提高了速度,而且使能源效率提高了 20%。

通往更個人化的人工智慧體驗的道路?

美光科技面向智慧型手機的下一代 RAM 和儲存解決方案不僅旨在提升 AI 效能,更致力於全面加速日常智慧型手機任務的執行。我很好奇 G9 升級的 NAND 行動 UFS 4.1 儲存和 1γ(1-gamma)LPDDR5X RAM 是否也能加速離線 AI 處理器。

智慧型手機製造商和人工智慧實驗室正越來越多地轉向本地人工智慧處理。這意味著,您無需將查詢傳送到雲端伺服器進行處理,然後透過網路連線將結果傳送到您的手機,而是整個工作流程都在您的手機本地執行。

從轉錄通話和語音筆記,到將複雜的研究資料處理成 PDF 文件,一切都在您的手機上進行,您的個人資料絕對不會離開您的裝置。這是一種更安全、更快捷的方法,但也需要大量的系統資源。更快、更有效率的記憶體模組是這些基本要求之一。

美光的下一代解決方案能否協助本地 AI 處理?答案是肯定的。事實上,它們還能加速需要雲端連接的流程,例如使用Google Veo 模型進行視訊創作,這仍然需要強大的運算伺服器。

「直接在設備上運行的原生AI應用程式將擁有最大的流量,因為它不僅從儲存設備讀取用戶數據,還在設備上執行AI推理,」Rivera說。 “在這種情況下,我們的功能將有助於優化兩者的數據流。”

那麼,搭載美光最新解決方案的手機何時上市呢? Rivera 表示,所有主流智慧型手機製造商都將採用美光的下一代 RAM 和儲存模組。就上市時間而言,「2025 年底或 2026 年初推出的主要機型」應該會成為你的購物首選。

評論被關閉。