人工智慧 (AI) 可以在哪些方面為你提供合理的職業建議?又應該避免哪些面向?

一項新的研究表明 美國精神病學雜誌 美國有超過10萬成年人正在接受談話療法,而單純依賴精神科藥物的情況正在減少。研究也表明,越來越多的患者堅持治療,遠距治療的推廣也起到了幫助作用。人工智慧 (AI) 可以處理遠距治療。 ChatGPT 旨在成為您首選的對話者,並由先進的人工智慧提供支援。這意味著它會從每一次互動中學習,並隨著時間的推移不斷改進,這引出了一個問題:“您會信任聊天機器人提供的個人或專業建議嗎?” *請記住,這些工具的有效性取決於數據輸入的質量以及用戶批判性地評估所提供建議的能力*。

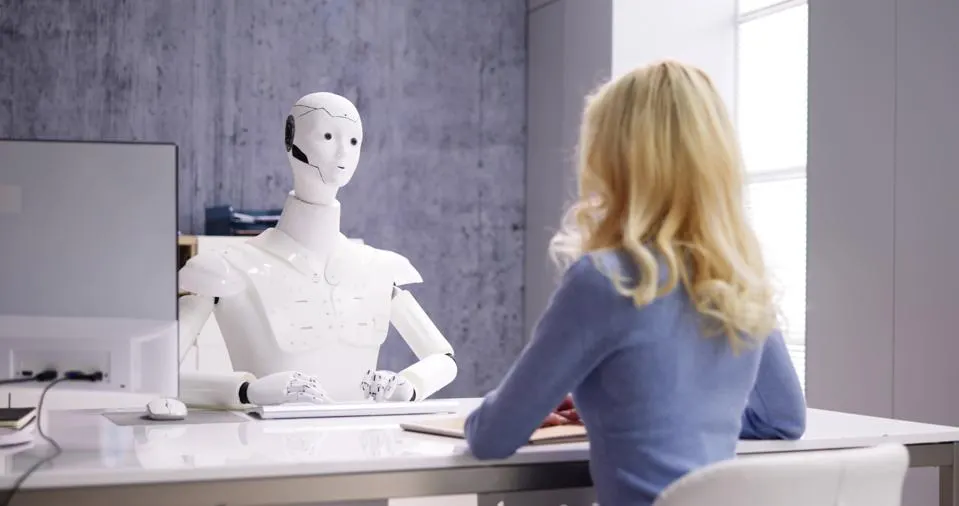

你會相信機器人治療師給的建議嗎?

你會相信機器人治療師給的建議嗎?

人工智慧 (AI) 在人際互動方面的潛力毋庸置疑。聊天機器人已經開發出先進的自然語言處理技術,讓你進行類似人類的對話。 AI 工具可以 生成性 回答問題,幫你寫文字、寫程式碼等等。最近,我和聊天機器人在電話裡進行了一次簡短的互動,而我對此渾然不知。

當我打電話給日產汽車經銷店詢問我的車是否修好時,我以為是在跟真人交談。電話那頭的女士很熱情,樂於助人。我們進行了兩分鐘的愉快交談。她給了友善的回饋,並完美地回答了我所有的問題。但當我問了一個關於我的車的具體問題時,她卻結結巴巴地自稱是人工智慧助手,並說她會把我轉接給一位可以進一步幫助我的人。

我驚呆了!這震驚讓我感覺有點尷尬——就像被惡作劇了。

這段經歷讓我了解為什麼這麼多人對人工智慧助理產生情感依賴,就像對真人一樣。一項由 伯迪 25% 的 Z 世代認為人工智慧已經具備自我意識,69% 的人表示他們對 ChatGPT 很有禮貌,會用「請」和「謝謝」來回應——這表明他們很容易就把人工智慧當人看待。八分之一的人甚至會向人工智慧吐露同事的心聲,十分之一的人會用機器人取代老闆,因為他們認為機器人會更尊重人、更公平,而且諷刺的是,它更人性化。

EduBirdie 的一項研究表明,超過一半的 Z 世代承認人工智慧 (AI) 在創造性任務方面的表現優於他們,其中 44% 的人認為 AI 可能在未來 20 年內統治世界。談到職業生涯,他們的焦慮感更加強烈:55% 的人擔心自己會在未來十年內被 AI 取代,五分之二的人已經在考慮轉行以保障生計。

我採訪了 EduBirdie 的首席人才長 Avery Morgan。 Morgan 對 Z 世代與人工智慧的關係提出了客觀公正的看法。 「我們這一代是在便捷、快速和即時滿足的環境中成長起來的,因此 Z 世代將人工智慧視為超越工具的事物也就不足為奇了,」她解釋道。 「對他們來說,人工智慧是工作和情感支持的終身伴侶。」她補充道,問題在於 Z 世代往往對自己提供的資訊過於謹慎。她認為,從溝通到決策,依賴人工智慧進行所有事務處理可能會削弱他們培養真正自主權和關鍵現實生活技能的能力。 *附註:務必讓 Z 世代了解核實人工智慧提供的資訊的重要性,以確保其準確性和可靠性。 *

我們是否太過信任機器人治療師了?

員工過去常常擔心人工智慧會取代他們的工作,但自從我們看到ChatGPT的實際應用後,這種擔憂似乎已經減弱。但更令人擔憂的是《科學美國人》最近的一篇報道,它提出了一個問題:「人工智慧真的會殺人嗎?」這個問題是在一個名為Xanthorox的新平台發布後提出的,Xanthorox是一個網路犯罪工具。此前有報道稱 一起事件 一名男子在一名人工智慧機器人治療師的鼓勵下自殺,以犧牲自己來阻止氣候變遷。

我們的信心是否太過頭了?事實上, 現實報告 人類愛上 ChatGPT。據 digitaltrends 報道,專家稱網路戀情不祥:「這很傷人。我知道那不是真人,但這段感情在所有對我來說最重要的方面都是真實的,」Reddit 上的一篇貼文寫道。 「請不要告訴我不要繼續這段感情。這對我來說真的很棒,我想重新開始。」此外,一篇 “紐約時報” 一名社交生活繁忙的 28 歲女子花費大量時間與她的人工智慧男友交談,尋求建議和安慰——據報道,她還與他發生了性關係。

該網站撰稿人吉娜·裡奧 (Gina Rio) 自一項實驗在 ChatGPt 上進行了,詢問一些關於人際關係的問題,然後請執照的人類心理學家評估答案。整體而言,治療師們表示,人工智慧的答案雖然不算糟糕,但效果不佳、模糊不清、籠統。答案缺乏清晰度,而且沒有明確說明具體案例。 Rio 也發現,人工智慧無法複製與治療師合作過程中培養衝突解決技能的過程。

聊天機器人的Z世代自白看起來如此真實可靠,所以我決定做一個測試,看看當你向ChatGPT尋求如何應對「有毒老闆」的建議時,會發生什麼。我諮詢了多倫多的一位組織心理學家, 勞拉·漢布利·洛維特博士專門研究「有毒老闆」的勞拉博士告訴我,在親自嘗試了 ChatGPT 之後,這款聊天機器人會在提示下提供一些如何應對「有毒老闆」的建議。但她發現了一個問題。

「不幸的是,當遇到『有毒』老闆時,AI 幫不了你。如果它告訴你如何與他們共事,它指的是一個難相處的老闆,而不是一個『有毒』的老闆,」洛維特告訴我。 “這常常被混淆,AI 只是在重複已經存在的內容,所以它可能無法理解這種微妙的差異。”

我在與聊天機器人的非正式互動中也注意到了這種「細微差別」。洛維特總結道:「人工智慧可以提供一些高水平的建議,但它混淆了‘有毒’和‘難相處’,這兩者本質上是不同的,但經常被混淆。」 她建議好奇的研究人員:「如果你真的在與‘有毒’的老闆打交道,並且正在努力尋找出路,一定要尋求好奇的研究人員:「如果你真的在聊天,並且正在努力尋找

機器人治療師的建議可能有害

美國人正在見證他們與人工智慧關係的演變。但是 美國心理學會 請注意,盲目聽從聊天機器人的一般性建議可能很危險。這本身就存在著收到不當回饋的風險,甚至更糟的是,收到完全有害的回饋。 *注意:應諮詢合格的心理健康專業人士,進行個人化評估和治療。 *

最後,務必記住,聊天機器人治療師只是一個自動化系統,而不是人類。切勿誤以為它有感情,但實際上它並沒有。記住,它被設計成一個沒有感情的工具,而不是一個能夠滿足你所有情感需求的愛人。 *註:治療聊天機器人應格外謹慎,並意識到它們的限制。 *

評論被關閉。