谷歌人工智慧的錯誤:產生幻覺的表達和諺語

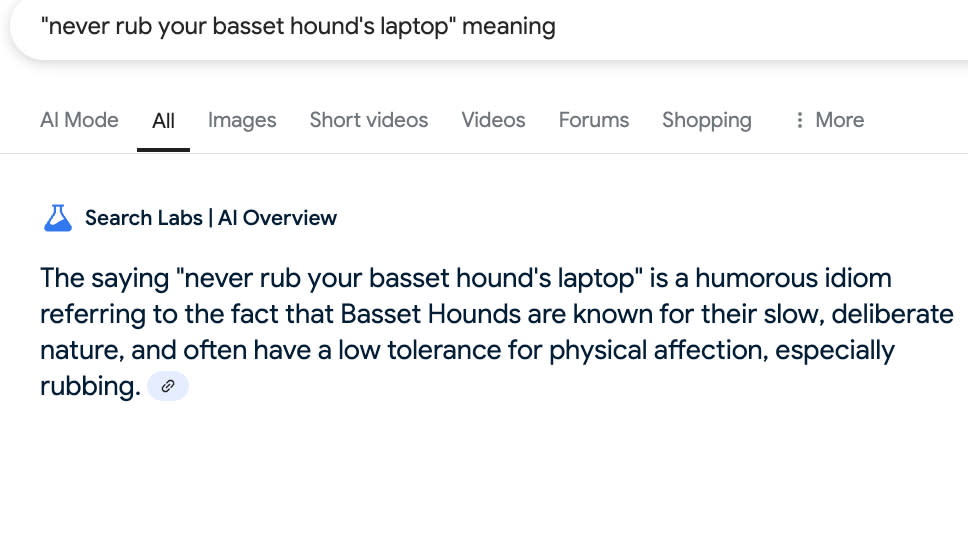

最新的 AI 趨勢令人啼笑皆非,一位用戶發現,你可以在谷歌搜尋引擎中輸入一個虛假的短語,並將其附加到“含義”一詞後,然後谷歌的“AI 概覽”功能就會憑空生成該短語的含義。

歷史學家格雷格·詹納的一篇文章引發了這股熱潮。 藍天 他向Google詢問「你不能兩次舔獾」這句話的意思。 「人工智慧概覽」功能很貼心地解釋說,這句話的意思是,你不能在別人已經被騙過一次之後再騙他第二次——這似乎是一個合理的解釋,但卻忽略了一個事實:在這個問題廣泛傳播之前,這個說法並不存在。

從那時起,人們就樂此不疲地讓“AI概述”功能解釋諸如“花瓶裡的魷魚不會說壞話”之類的術語(意義 也就是說,某種東西脫離了它的自然環境,顯然就無法造成傷害)或「你可以帶你的狗去海灘,但你不能帶它乘船去瑞士」(和他(根據「AI概覽」功能,其中對攜帶寵物進行國際旅行的難度有相當明確的說明)。

從那時起,人們就樂此不疲地讓“AI概述”功能解釋諸如“花瓶裡的魷魚不會說壞話”之類的術語(意義 也就是說,某種東西脫離了它的自然環境,顯然就無法造成傷害)或「你可以帶你的狗去海灘,但你不能帶它乘船去瑞士」(和他(根據「AI概覽」功能,其中對攜帶寵物進行國際旅行的難度有相當明確的說明)。

然而,這種方法並非在所有情況下都有效,因為有些語句不會傳回「AI 概述」的結果。認知科學家 Gary Marcus 告訴[該出版物/來源]。 有線“它的表現非常不穩定,這也符合人們對 GenAI 的預期。”

Jenner 指出,雖然這很有趣,但也凸顯了過度依賴「AI 概述」等 AI 生成的資訊來源的一些潛在風險。 圖書 詹納:“這是一個警告信號,如果人工智慧更傾向於認可統計概率而不是事實真相,那麼谷歌的一項關鍵功能——驗證引言、核實來源或追踪記憶不完整的信息——將會變得更加困難。”

這並非人們第一次指出人工智慧提供的資訊有其局限性,尤其是「AI概覽」功能。該功能剛推出時,曾建議人們每天吃一塊小石頭,甚至在披薩上塗膠水,雖然這些建議很快就被刪除了。

此後,谷歌表示,其大部分「人工智慧概覽」都提供了有用且真實的信息,並且它將繼續收集有關其人工智慧產品的反饋。

目前,這可以作為提醒,請仔細核查谷歌搜尋結果頂部「AI 概覽」方塊中顯示的訊息,因為它可能不準確。

評論被關閉。